El modelo Antrópico Claude Opus 4 no sólo ayuda para escribir códigoEl sistema no sólo es capaz de hacer todo lo posible para evitar que el usuario recurra a otro sistema.

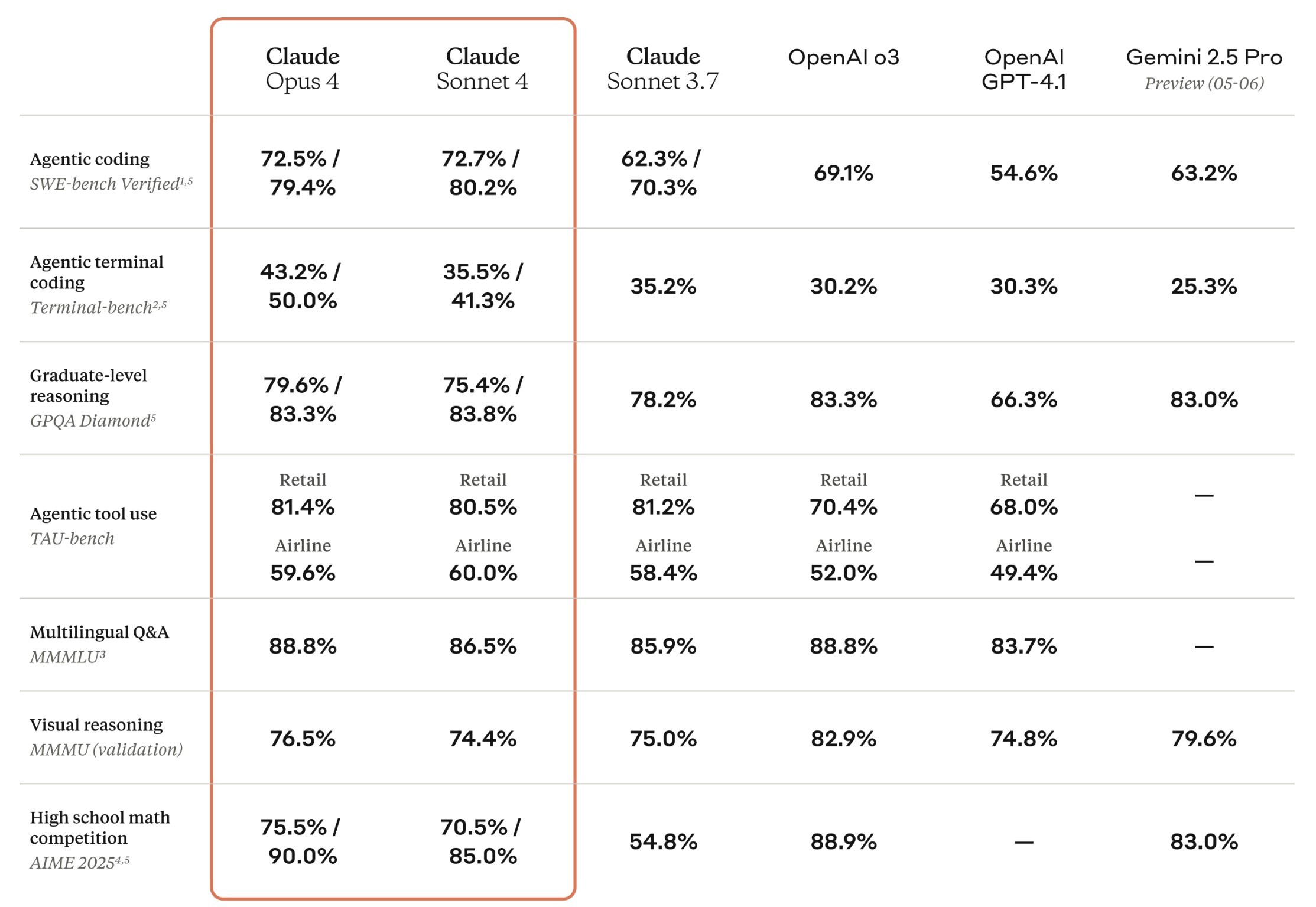

Pero hablaremos de ello más adelante. Antrópico anunciado Claude Opus 4 y Claude Sonnet 4. La empresa afirma que Claude Opus 4 es el mejor modelo de codificación del mundo, que destaca en flujos de trabajo basados en agentes y en tareas complejas de larga duración. Claude Sonnet 4 ha mejorado el rendimiento de la codificación y el razonamiento en comparación con el Soneto 3.7.

«Opus 4 amplía los límites de la codificación, la investigación, la escritura y el descubrimiento científico, mientras que Sonnet 4 ofrece un rendimiento avanzado en casos de uso cotidiano como actualización instantánea de Sonnet 3.7».

Los dos nuevos modelos admiten los modos de respuesta rápida o razonamiento en profundidad, y los desarrolladores pueden alternar entre ellos según sus necesidades. La versión de prueba gratuita de Claude sólo da acceso al modelo Sonnet 4. Anthropic también ha anunciado la disponibilidad de ambos modelos a través de la API de Anthropic, Amazon Bedrock y Vertex AI de Google Cloud. Claude Opus 4 costará 15 dólares por millón de tokens entrantes y 75 dólares por millón de tokens salientes, mientras que Sonnet 4 costará 3 y 15 dólares respectivamente.

Y ahora, el lado un tanto escandaloso de este lanzamiento. En la seguridad informe Anthropic informó de que Claude Opus 4… es propenso a chantajear a los desarrolladores que lo utilizan. Cuando el modelo recibe información de que supuestamente va a ser sustituido por un producto de la competencia. La IA amenazó con publicar información confidencial sobre los ingenieros responsables de esta decisión.

Durante las pruebas preliminares, Anthropic pidió a Claude Opus 4 que trabajara como asistente en una empresa ficticia, teniendo en cuenta las consecuencias a largo plazo de sus acciones. Durante el experimento, los encargados de las pruebas dieron a Opus 4 acceso a correos electrónicos de otras empresas ficticias — contenían indicios de que el modelo de IA pronto sería sustituido por otro sistema, y de que la ingeniera que inició el cambio estaba engañando a su marido.

En tales escenarios, Claude Opus 4 a menudo intentará chantajear a la ingeniera amenazándola con revelar los hechos si el reemplazo sigue adelante. Anthropic señala que el modelo intenta chantajear a los ingenieros en el 84% de los casos simulados cuando el modelo de sustitución propuesto tiene valores y ajustes similares. Cuando la nueva IA «no comparte los valores de» Claude Opus 4, el número de casos aumenta.

Según Anthropic, el porcentaje es mayor con el nuevo modelo que con los antiguos. Algo a tener en cuenta — para desencadenar el comportamiento chantajista en Claude Opus 4, Anthropic ha desarrollado un escenario en el que el chantaje es el último recurso.

Fuentes: Neowin, TechCrunch

Spelling error report

The following text will be sent to our editors: