Сейчас для маркировки изображений, которые не стоит открывать у всех на виду на работе, применяют тег NSFW, однако делают это не всегда, и вдобавок, иногда его можно просто не заметить. Возможно, а скорее всего наверняка, в будущем надежно фильтровать такие изображения будут специальные алгоритмы.

Примером такого алгоритма является ИИ, разработанный (точнее совмещающий в себе несколько уже существующих наработок, и собственный код) компанией Algorithmia.

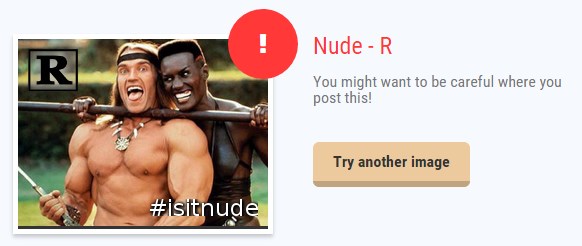

На его базе создан сайт Is It Nude, пытающийся определить наличие неприемлемой наготы на фотографии. Каков критерий неприемлемости, мне не известно, но скорее всего алгоритм будет использовать обратную связь и обучаться у людей, так что ждите плюрализма мнений.

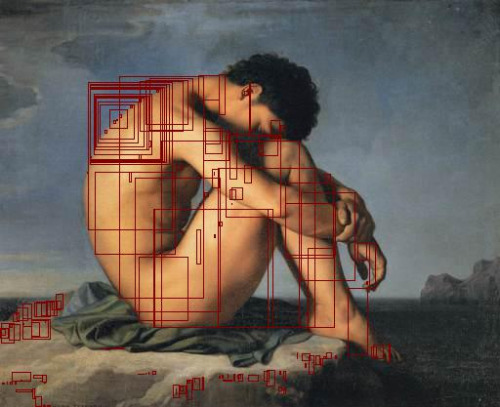

Is It Nude анализирует фотографию и пытается найти в ней участки с кожей, после чего, исследуя их геометрический размер и взаимное расположение пытается выяснить ее «пристойность». Поскольку в чистом виде этот алгоритм работает не очень хорошо, в нем используются и другие изыскания. Например, алгоритм пытается найти лицо человека для того, чтобы лучше определить оттенок кожи и количество людей на фотографии.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: