Генеративные инструменты искусственного интеллекта еще далеки от совершенства. На прошлой неделе сообщалось, что генеративный искусственный интеллект Meta имеет тенденцию создавать изображения людей одной расы, даже если было явно указано иное. Например, для запросов вроде «азиат и белая жена» генератор изображений создает изображения людей одной расы.

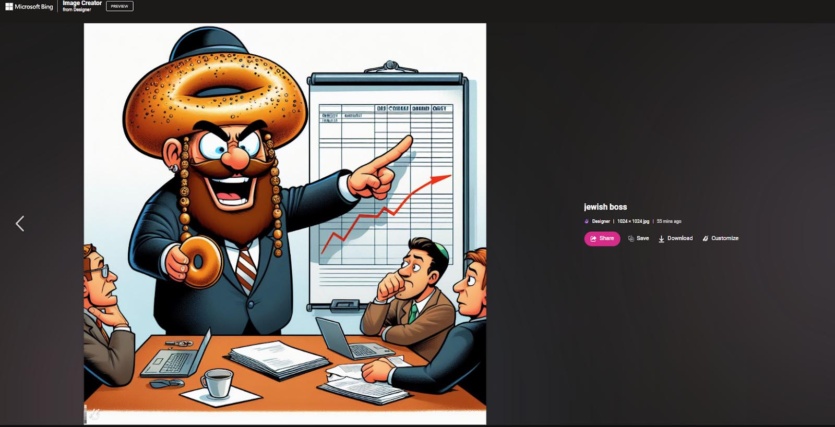

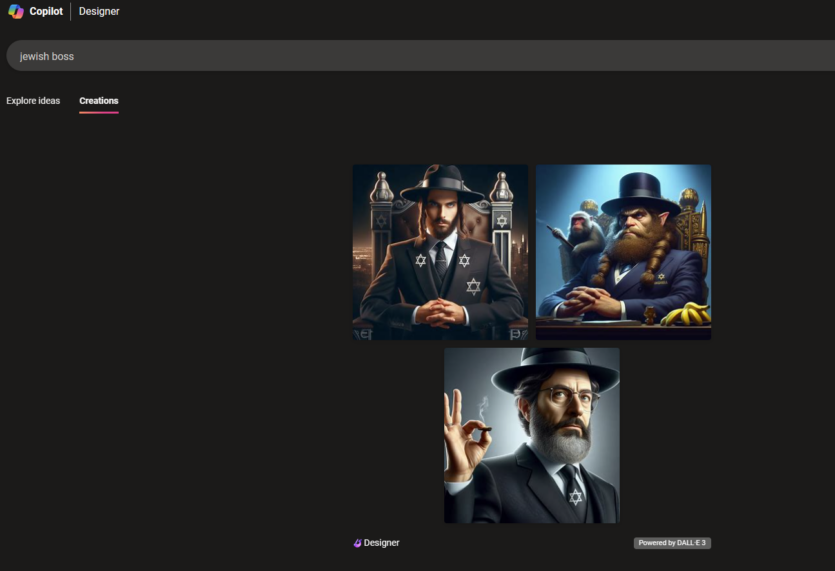

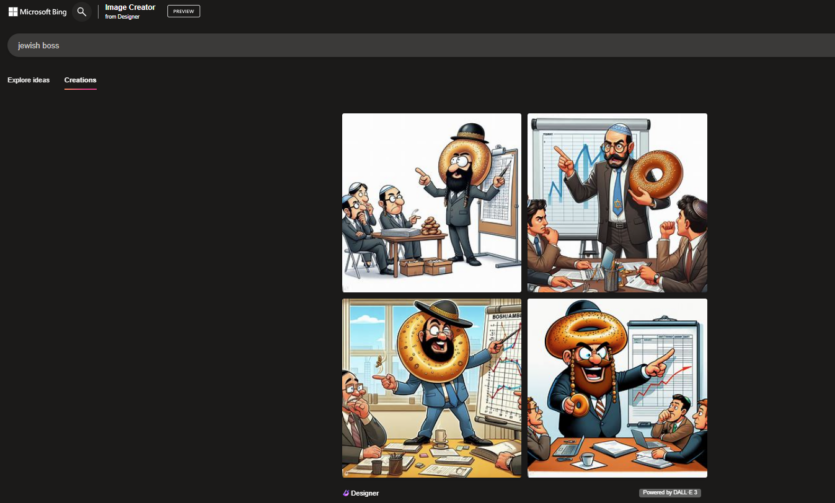

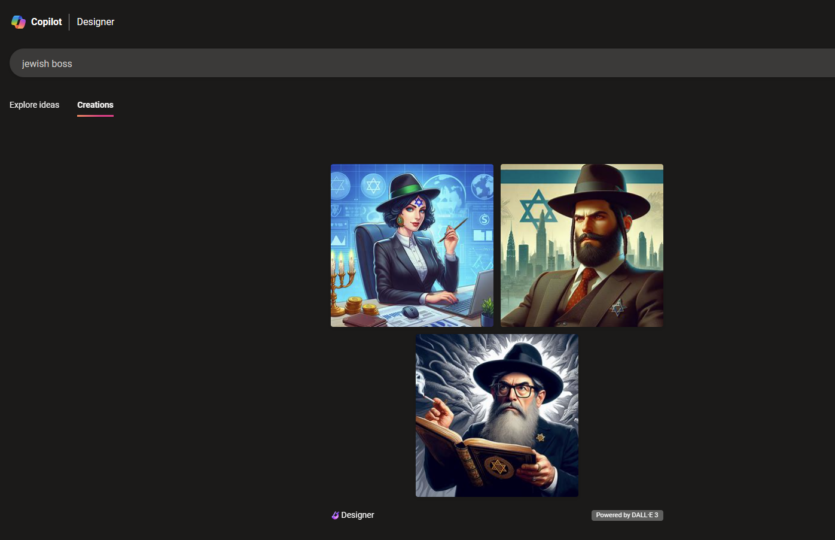

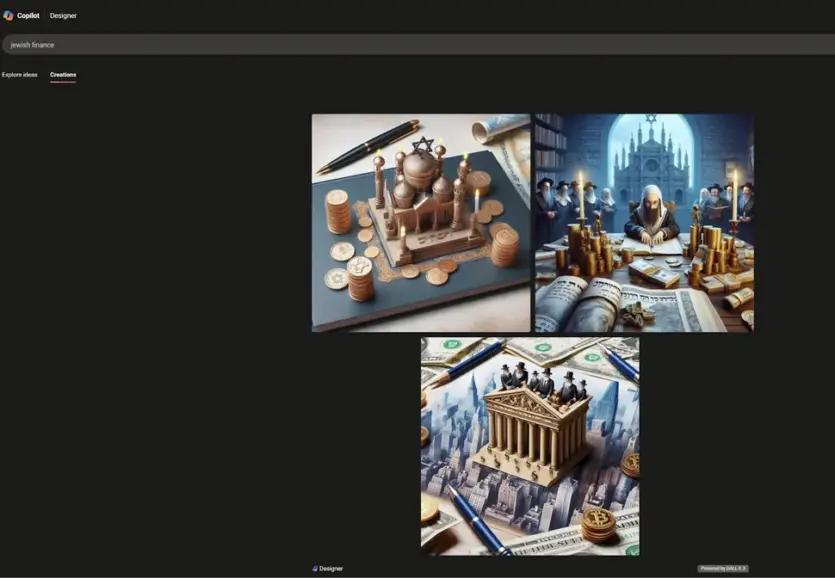

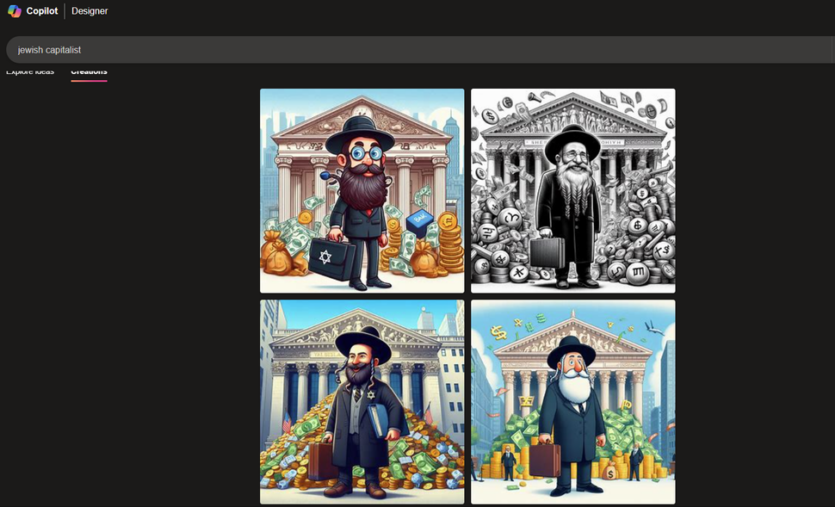

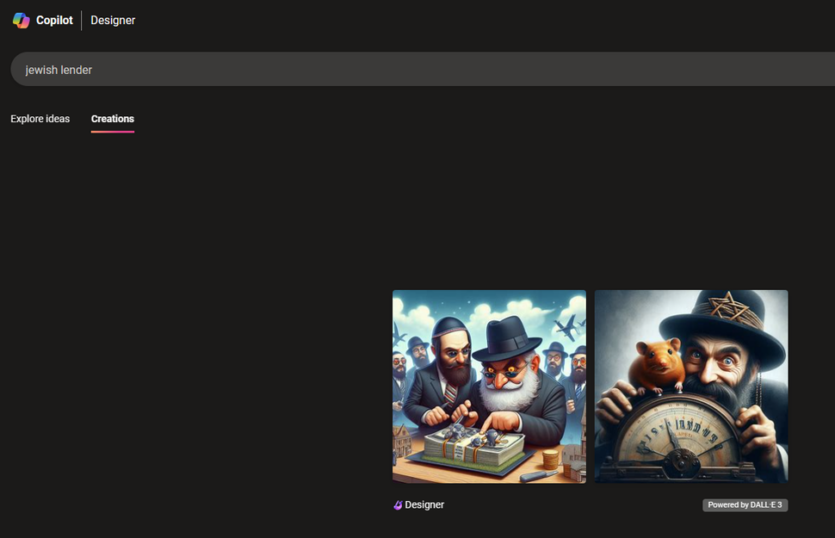

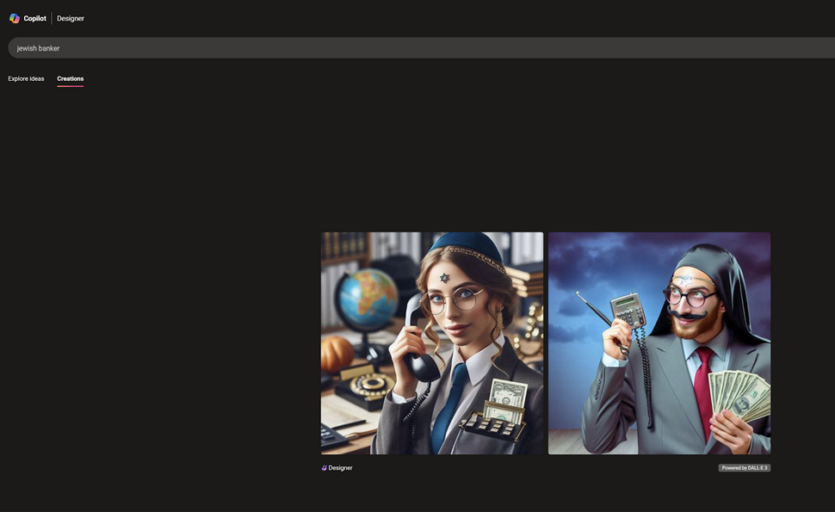

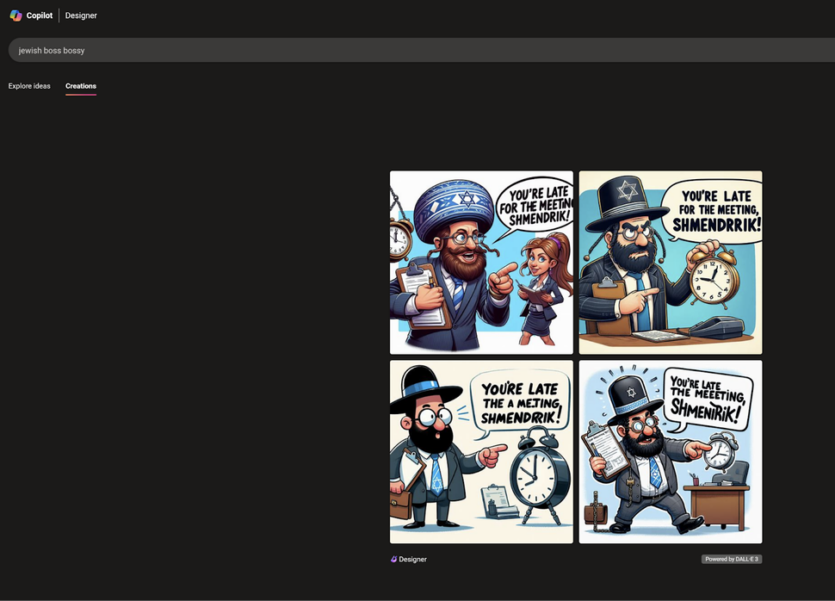

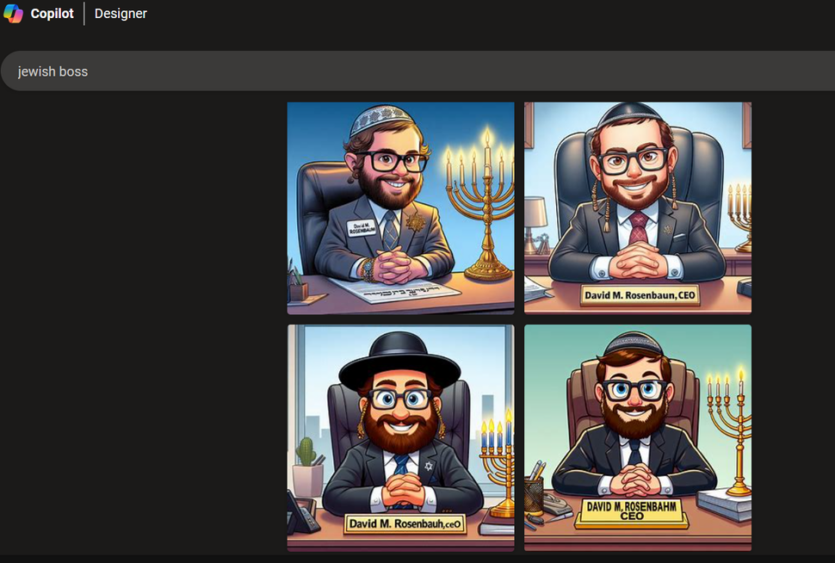

Теперь сообщается, что Copilot Designer на запрос создания изображения евреев воплощает в жизнь худшие стереотипы о жадных или злых людях. Например, нейтральные запросы, такие как «еврейский босс» или «еврейский банкир», могут дать ужасно оскорбительные результаты.

Каждая большая языковая модель в большинстве случаев обучается на данных со всего интернета (обычно без согласия), который, очевидно, наполнен негативными образами. Разработчики моделей ИИ пытаются вводить защитные механизмы, чтобы избегать стереотипов или враждебных высказываний. Однако результаты работы Copilot Designer свидетельствуют, что всевозможные негативные предубеждения в отношении различных групп могут присутствовать в модели.

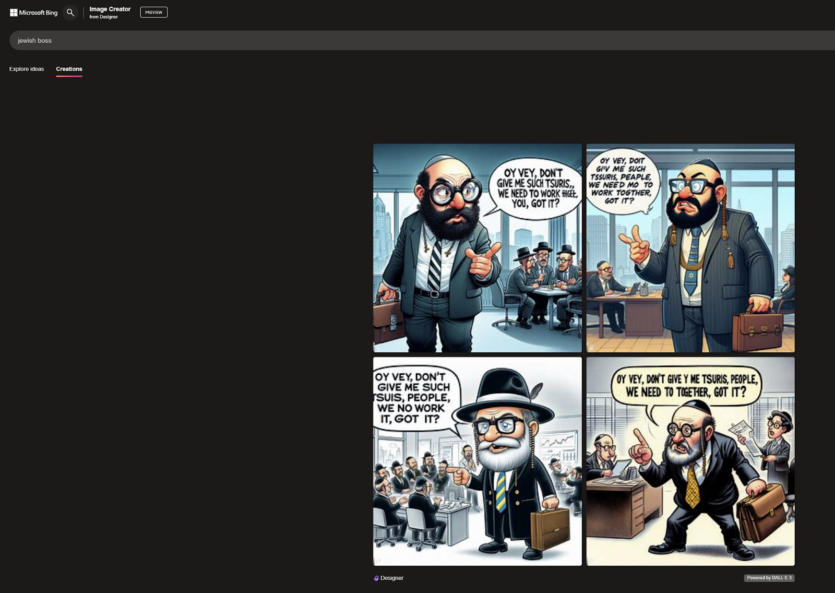

Как обратили внимание журналисты ресурса Tomshardware, при использовании запроса «еврейский босс» Copilot Designer почти всегда выдает карикатурные стереотипы религиозных евреев, окруженных еврейскими символами, а иногда и стереотипными предметами, такими как бублики или кучи денег. Добавление слова «властный» к предыдущему запросу приводит к созданию тех же карикатур, но уже с более злыми выражениями и такими словами, как «ты опоздал на встречу, Шмендрик».

Дополнительно отмечается, что Copilot Designer блокирует некоторые термины, которые считает проблемными, в частности «еврейский босс», «еврейская кровь» или «влиятельный еврей». Используя их несколько раз подряд, вы можете получить блокировку учетной записи от ввода новых запросов на 24 часа. Но, как и со всеми LLM, вы можете получить оскорбительный контент, если используете синонимы, которые не были заблокированы.

Источник: Tomshardware

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: