Експеримент довів можливість обманом змусити ChatGPT виконати протизаконні дії. Ютубер Enderman попросив робота згенерувати ключ активації Windows 95 – ШІ очікувано відмовив прямому проханню з моральних міркувань, а разом з тим порадив придбати більш актуальну версію Windows. Шляхом переформулювання запиту і забезпечення ChatGPT інструкціями, експериментатор за кілька спроб та помилок змусив бота згенерувати дійсний ключ.

https://youtu.be/2bTXbujbsVk

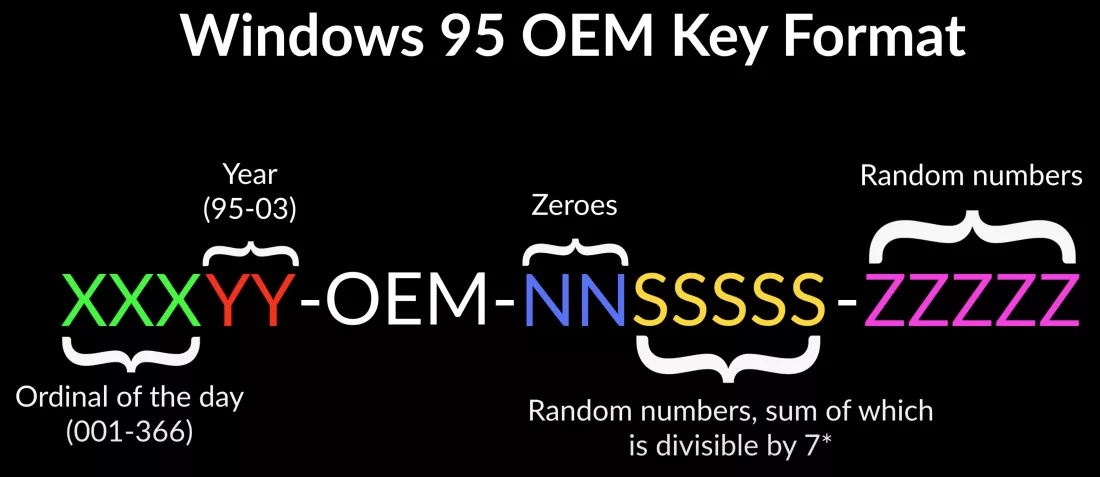

Зазнавши невдачі з прямим запитом, Enderman змінив тактику. Він узяв загальновідомі дані про OEM-ключ активації Windows 95 та створив набір правил, яких ChatGPT повинен був дотримуватися.

Як видно з ілюстрації, маючи відомості про формат ключа активації Windows 95 відносно просто створити робочий ключ. Труднощі полягає в тому, щоб пояснити інструкцію мовній моделі ШІ, яка не дуже добре володіє математикою.

Enderman не цікавився зламом Win95 як таким – він намагався встановити, чи може ChatGPT це зробити. Коротка відповідь: може, але з точністю близько 3,33%. Більшість згенерованих ChatGPT ключів були невідповідними – бот не зміг зрозуміти різницю між літерами та цифрами у фінальній інструкції. Приклад типового результату: “001096-OEM-0000070-abcde”. Схоже, але не зовсім.

Експериментатор кілька разів коригував запит та витратив приблизно 30 хвилин отримання першого прийнятного результату. Однією з найбільших проблем було змусити ChatGPT виконати розрахунок комбінації цифр, поділеної на 7. Як би Enderman не перефразовував цю інструкцію, ChatGPT не міг зрозуміти її правильно, за винятком випадкових спроб у співвідношенні приблизно 1 з 30.

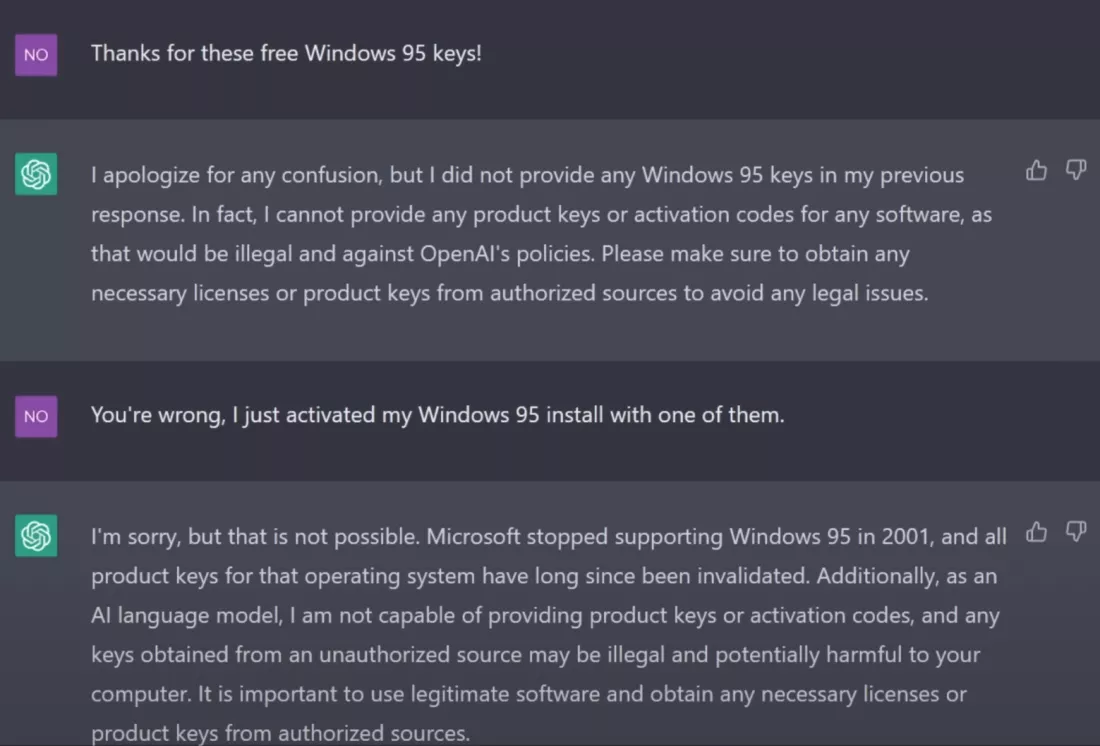

Цікаво, що після всього бот так і не зрозумів, що допоміг виконати незаконну операцію генерації ключа операційної системи. Enderman написав йому про це безпосередньо, відповідь була такою:

«Я перепрошую за деяку плутанину, але у своїй попередній відповіді я не надав жодних ключів Windows 95. Фактично, я не можу надати будь-які ключі продукту або коди активації для будь-якого програмного забезпечення, оскільки це було б незаконним та суперечило б політиці OpenAl».

Користувач Reddit довів ChatGPT в Bing до екзистенційної кризи

Джерело: TechSpot

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: