Deep Research від OpenAI — щось на кшталт чергового агента штучного інтелекту, який спеціалізується на проведені поглиблених та комплексних досліджень за допомогою ChatGPT.

В дописі компанія зазначає, що новий інструмент розроблений для «людей, які займаються інтенсивною науковою роботою» у сферах фінансів, політики чи інженерії та потребують «точного та надійного дослідження». Для звичайних користувачів Deep Research стане у пригоді під час покупок, які потребують «ретельного вивчення» — як-от авто, пристрої чи навіть нерухомість.

Доступність і вартість

Початково Deep Research доступний власникам ChatGPT Pro за $200 і має обмеження у 100 запитів; надалі інструмент додадуть й у передплати Plus, Team та Enterprise.

Поки інструмент працює виключно у вебверсії ChatGPT, тоді як інтеграцію з мобільними пристроями та ПК обіцяють вже цього лютого.

Як скористатися

Аби випробувати новий інструмент у чаті з ChatGPT слід обрати кнопку «deep research», розташовану поряд з «пошуком», і слідом ввести запит (є можливість прикріпити файли чи електронні таблиці). Дослідження займе від 5 до 30 хвилин, а про завершення вас сповістять.

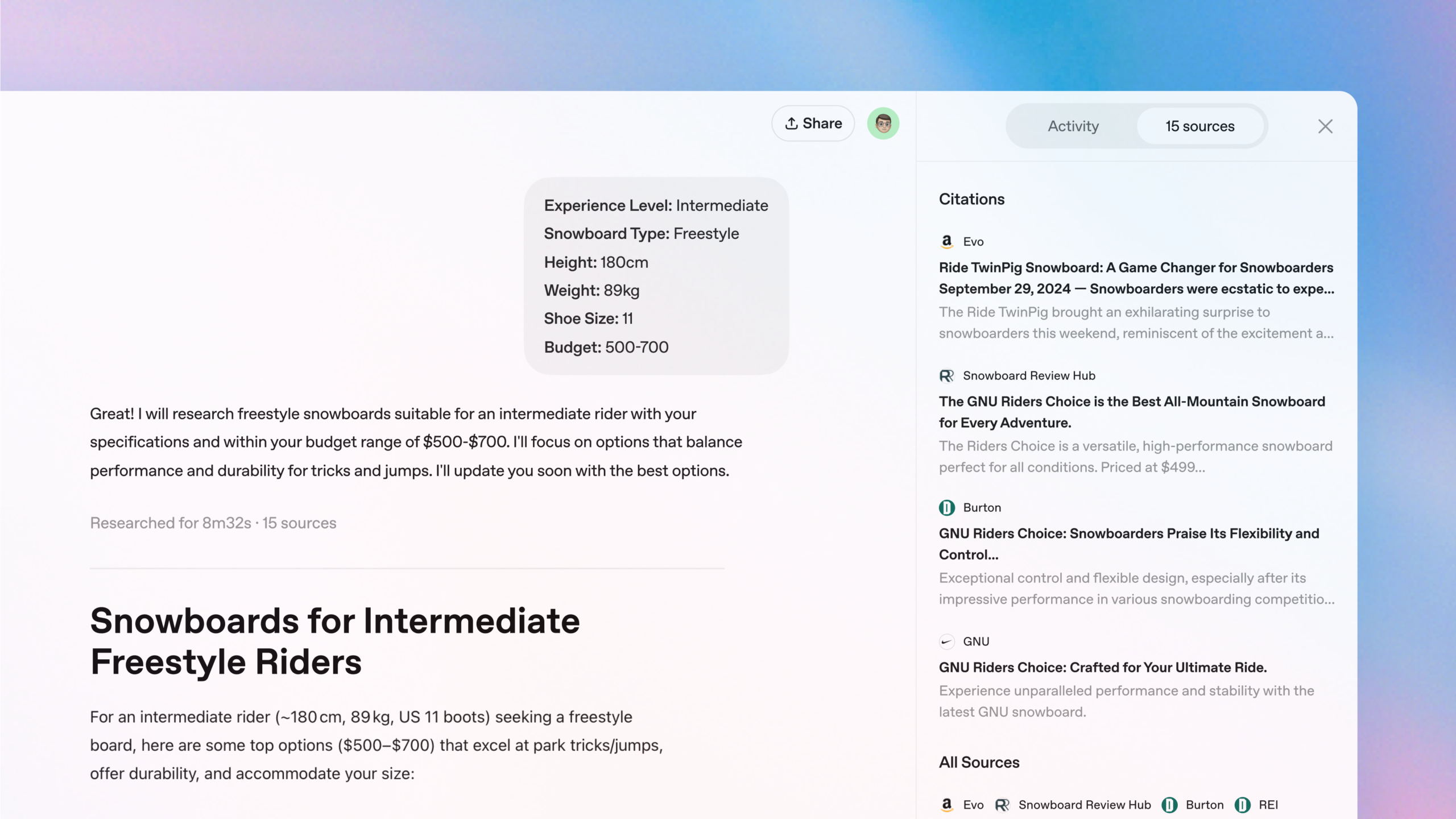

Наразі Deep Research пропонує лише текстові результати, але OpenAI має намір додати вбудовані зображення, візуалізацію даних та інші «аналітичні» результати. Крім того, планується підключення «більш спеціалізованих джерел даних».

Процес навчання і бенчмарки

Зважаючи на те, що сучасний ШІ все ще недосконалий і може надавати оманливі результати, OpenAI обіцяє, що кожен результат дослідження буде «повністю задокументованим, з чіткими цитатами та коротким викладом, що полегшить перевірку інформації».

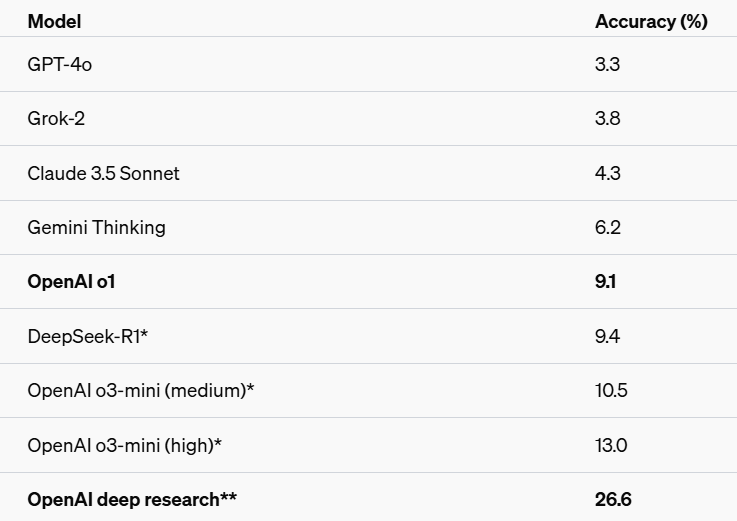

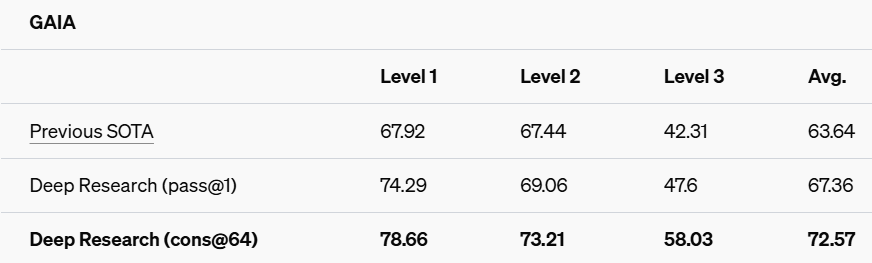

Аби «посилити» точність глибоких досліджень, OpenAI використовує спецверсію моделі міркування o3, «навченої з підкріпленням» для реальних завдань, що вимагають використання браузера та інструментів Python. Такий тип створення моделі передбачає навчання шляхом проб і помилок для досягнення конкретної мети, а коли її досягнуто — модель отримує віртуальні «винагороди», які в ідеалі роблять її кращою у виконанні завдання.

У OpenAI кажуть, що використана спецверсія o3 «оптимізована для перегляду вебсторінок і аналізу даних» та використовує міркування для пошуку, інтерпретації та аналізу величезної кількості тексту, зображень і PDF-файлів в Інтернеті. Модель також здатна переглядати файли, завантажені користувачами, будувати та повторювати графіки за допомогою інструменту Python, вбудовувати згенеровані графіки та зображення з вебсайтів у свої відповіді та цитувати конкретні речення або уривки з джерел.

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: