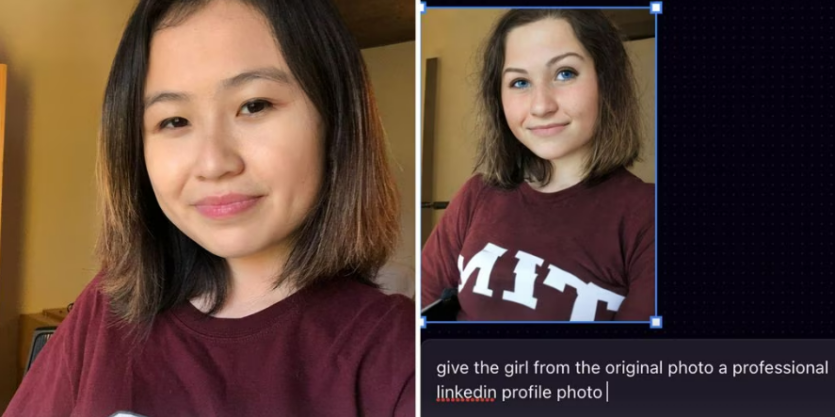

Американка азійського походження Рона Вонг була неприємно здивована, коли попросила ШІ зробити їй найбільш «професійне» фото для профілю в LinkedIn. Генеративна модель Playground AI змінила риси зовнішності дівчини, зробивши її білою.

Як відомо, соціальна мережа LinkedIn використовується для підтримки професійних контактів та пошуку вакансій. Контекст робить ситуацію набагато неприйнятнішою: виходить, ШІ вважає, що людині з такою зовнішністю легше знайти роботу?

was trying to get a linkedin profile photo with AI editing & this is what it gave me 🤨 pic.twitter.com/AZgWbhTs8Q

— Rona Wang (@ronawang) July 14, 2023

24-річна випускниця MIT, Рона Вонг вивчала математику, інформатику та закінчила аспірантуру минулої осені. Вона буквально попросила «дати дівчині з оригінальної фотографії професійне фото для профілю LinkedIn». У відповідь на цей запит ШІ зробив її очі ширшими та блакитними, освітлив шкіру та європеїзував інші риси.

«Першою моєю реакцією на результат був подив. Проте я рада бачити, що це стало каталізатором ширшої дискусії про упередженість ШІ… Расова упередженість є постійною проблемою інструментів ШІ. Я й досі не отримала придатних для використання результатів від генераторів фото або ШІ-редакторів зображень, тому поки що мені доведеться обходитися без нової фотографії профілю LinkedIn».

Вонг висловилася і про схожу проблему на іншому кінці зв’язки «кандидат-роботодавець»: якщо компанії використовують ШІ для пошуку співробітників, моделі можуть підбирати їм кандидатів за тим же принципом – найбільш схожих на білих.

«Я впевнено вважаю, що це проблема. Я сподіваюся, що люди, які створюють програмне забезпечення, знають про ці упередження та думають про те, як їх пом’якшити».

The models aren’t instructable like that so it’ll pick any generic thing based on the prompt. Unfortunately, they’re not smart enough.

Happy to help you get a result but it takes a bit more effort than something like ChatGPT.

— Suhail (@Suhail) July 14, 2023

Засновник Playground AI Сухейл Доші відповів дівчині: «Моделі не інструктуються, тому вони обирають будь-яку спільну річ на основі підказки. На жаль, вони недостатньо розумні. Радий допомогти вам отримати результат, але це вимагає трохи більше зусиль».

Нещодавнє дослідження компанії Hugging Face, що спеціалізується на штучному інтелекті, показало, що ШІ-генератори зображень мають проблеми з гендерними та расовими упередженнями.

Дослідження з’ясувало, що коли DALL-E2 пропонували створити зображення людей на керівних посадах, у 97% випадків він створював зображення білих чоловіків. Це пояснили тим, що ШІ був навчений на упереджених даних, які посилюють стереотипи.

Джерела: Boston Globe, Insider

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: