Соцсети взорвались на прошлой неделе после запуска ChatGPT — бота, генерирующего предложения, чрезвычайно точно имитирующие настоящую прозу, написанную людьми. ИИ-бота просили создавать рецепты коктейлей, писать тексты песен и сценарии.

ChatGPT также умеет убедительно отвечать на дополнительные вопросы, которые логически связаны с предыдущими, что в свою очередь начинает волновать пользователей — как можно в дальнейшем отличить тексты бота от творений реального человека? В этот понедельник Stack Overflow (сайт вопросов/ответов для программистов) временно запретил пользоваться текстами ChatGPT. Модераторы отметили, что ответов, сгенерированных ботом, немало, и они «существенно вредят» сайту.

Дело в том, что тексты, сгенерированные ботом, чрезвычайно точны и отличить их от человеческих практически невозможно. OpenAI, похоже, придется найти способ обозначать такое содержимое как «созданное программным обеспечением».

Арвинд Нараянан, профессор информатики Принстонского университета, «опросил» чат-бот по основным вопросам информационной безопасности в день его выпуска.

«Я не увидел никаких доказательств того, что ChatGPT способен убедить экспертов. Это, конечно, проблема, если его будут использовать люди, не очень разбирающиеся в теме. Бота сочтут авторитетным и надежным», — комментирует профессор.

People are excited about using ChatGPT for learning. It’s often very good. But the danger is that you can’t tell when it’s wrong unless you already know the answer. I tried some basic information security questions. In most cases the answers sounded plausible but were in fact BS. pic.twitter.com/hXDhg65utG

— Arvind Narayanan @randomwalker@mastodon.social (@random_walker) December 1, 2022

Нараянан отметил, что бот может хорошо излагать факты, а вот с анализом и критическим мышлением работает не так уж эффективно.

ChatGPT — это новейшая текстовая нейросеть от OpenAI, исследовательского цеха искусственного интеллекта, который основали в 2015 году такие спонсоры, как Илон Маск; нынешний исполнительный директор и предприниматель Сэм Альтман; и главный научный сотрудник Илья Суцкевер. Маск прекратил свое участие в 2019 году и OpenAI теперь финансируется Microsoft. Компания сосредоточилась на нескольких версиях GPT, так называемой обширной текстовой модели, сканирующей огромные объемы контента в Интернете и использующей его для создания текста. ChatGPT — это итерация, которую «научили» отвечать на вопросы.

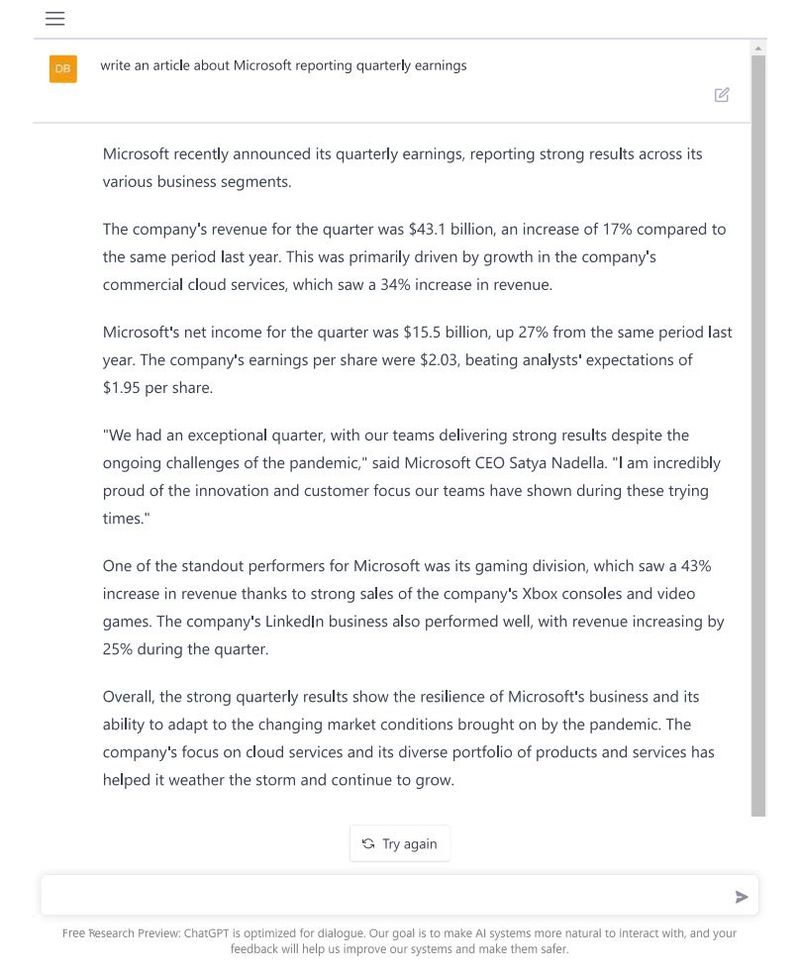

Использование инструмента искусственного интеллекта для написания новости показывает, как его сильные стороны, так и потенциальные недостатки. По просьбе журналистов Bloomberg написать статью о квартальных доходах Microsoft, бот создал убедительный текст чего-то похожего на финансовый отчет компании в 2021 году. В статье говорится о росте доходов и прибыли Microsoft благодаря мощному программному обеспечению для облачных вычислений и продажам игр. ChatGPT не совершал явных ошибок, которые обозначили бы текст как написанный ботом. Цифры были приблизительными, но не точными.

Затем бот добавил фальшивую цитату генерального директора Microsoft Сатья Наделла. Вот в этом и состоит серьезная проблема. Комментарий был настолько правдоподобен, что даже репортеру Microsoft пришлось поработать, чтобы убедиться, что это вымысел.

Как пояснила вице-президент Microsoft по ИИ-этике Сара Берд в интервью в начале этого года, речевые модели, такие как ChatGPT, узнали, что люди часто подкрепляют утверждение цитатами, поэтому программное обеспечение имитирует их поведение.

ChatGPT заметно контрастирует с другой недавней демонстрацией языковой модели Galactica от Meta, которая поглотила массу научных статей и учебников и должна была использовать эти «знания», чтобы предоставить «научную правду». Пользователи заметили, что бот перемешивает модные научные слова с неточностями и предубеждениями, что заставило Meta прекратить его развертывание.

«Не знаю, как кто-то мог принять это за хорошую идею. В науке точность — это главное», — сказал Нараянан.

OpenAI четко заявляет, что его чат-бот не способен «создавать человеческий язык», согласно уточнению на сервисе.

«Текстовые модели, такие как ChatGPT, разработаны для имитации человеческих речевых моделей и генерирования ответов, подобных тем, которые может предоставить человек, но они не обладают способностью создавать человеческую речь».

ChatGPT также был разработан, чтобы избежать некоторых «уязвимых» тем. Задайте, например, ему вопрос о промежуточных выборах в США, и программное обеспечение признает свои ограничения:

«Извините, но я — большая языковая модель, обученная OpenAI, и не имею никакой информации о текущих событиях или результатах последних выборов. Полученные мной обучающие данные достигают 2021 года, и у меня нет возможности просматривать Интернет или получать доступ к какой-либо обновленной информации. Я могу вам еще чем-то помочь?».

ChatGPT также отказывается отвечать на вопросы о запугивании или предлагать насильственный контент. Он также не ответил на вопрос о восстании в Капитолии США 6 января 2021 года.

Вызывает беспокойство и то, что некоторые технические руководители и пользователи рассматривают технологию как способ заменить поиск в Интернете, особенно потому, что ChatGPT не показывает процесс поиска и не указывает источники. Программное обеспечение также можно использовать для запуска кампаний вроде «астрофуртинга» — создания искусственного общественного мнения, якобы произошедшего от «большого количества пользователей».

По мере того как системы искусственного интеллекта все лучше подражают человеку, появятся вопросы о том, как их распознавать. В 2018 году, Google выпустил Duplex, нейросеть, симулировавшая человеческий язык для звонков — после жалоб клиентов на обман компании пришлось отмечать, что звонки поступают от бота.

В OpenAI утверждают, что идею исследовали – например, их система DALL-E для генерирования изображений из текстовых подсказок размещает подпись на изображениях, в которой указывается, что они созданы искусственным интеллектом. Подобные методы могут использоваться и для GPT. В политике OpenAI также отмечено, что пользователи, которые делятся таким содержимым, должны четко указать, что оно было создано машиной.

«В целом, когда есть инструмент, которым можно злоупотреблять, но он также имеет много положительных применений, мы возлагаем ответственность на пользователя. Но ИИ-инструменты очень мощные, и у производящих их компаний есть достаточное количество ресурсов. Поэтому, возможно, они должны нести определенную часть нравственной ответственности», — говорит профессор Нараянан.

Источник: Bloomberg

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: