Лучшие умы человечества пока еще не создали обладающий самосознанием искусственный интеллект, но они неуклонно движутся в этом направлении, терпеливо обучая компьютеры разнообразным навыкам: видеть, читать и понимать человеческую речь. В прошлом месяце разработчики Google продемонстрировали возможности программного обеспечения Deep Dream, способного распознать объекты на изображениях и интерпретировать увиденное на свой манер, превращая фрагменты фильмов в устрашающее слияния плоти и щупалец. И вот сейчас на The Verge появилась не менее увлекательная публикация, в которой рассказывается о схожей разработке исследователей Стэнфордского университета – алгоритме NeuralTalk, который распознает и характеризует изображения с такой точностью, что порой возникает ощущение бегающих по коже мурашек.

Впервые о существовании данной технологии стало известно еще в 2014 году после публикации соответствующего исследования, авторами которого являются директор Стэнфордской лаборатории искусственного интеллекта Фей-Фей Ли и его аспирант Андрей Карпаши. Тем не менее, широкому освещению в СМИ данное исследование удостоилось только после нижеприведенного сообщения в Twitter аналитика Тима Макнамары с наглядной демонстрацией возможностей последней версии алгоритма. Прикрепленное к твиту фото, «машина» описала следующим образом: «мужчина пользуется ноутбуком, а его кот смотрит на экран».

A computer just captioned this as «man using his laptop while his cat looks at the screen» http://t.co/bfwr1wiiFn pic.twitter.com/1F18NCwVf9

— Tim McNamara (@timClicks) 11 июля 2015

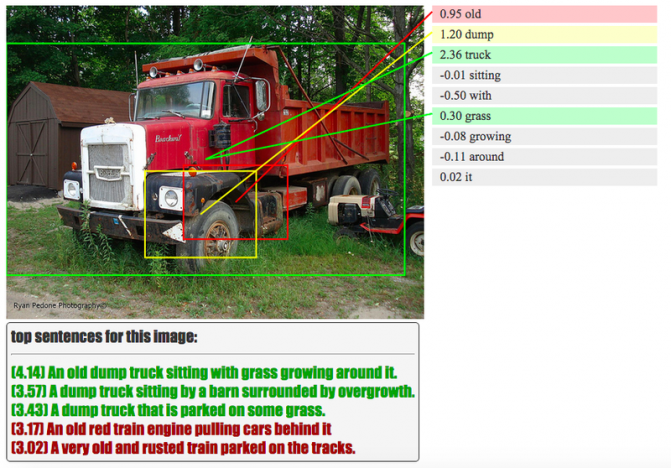

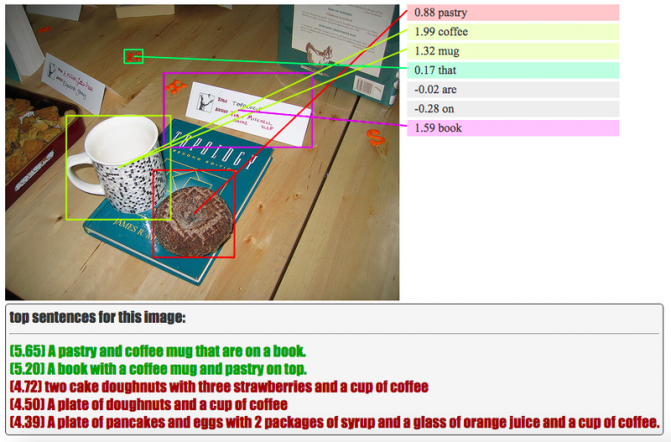

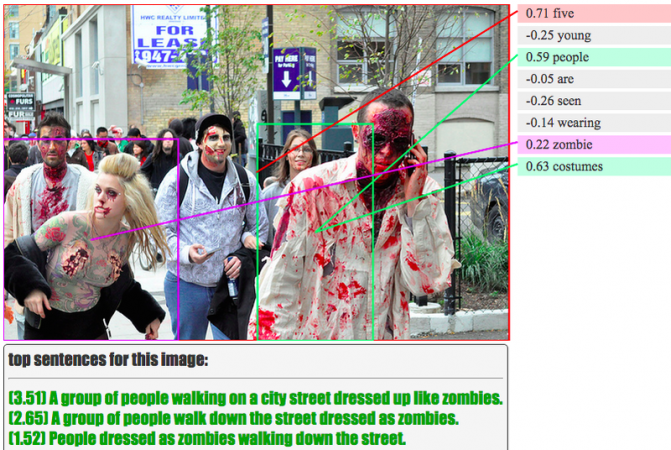

Как и Google Deep Dream, алгоритм NeuralTalk использует возможности искусственной нейронной сети (ИНС) для детального анализа каждой фотографии. В процессе анализа о ИНС сравнивает фрагменты изображения с ранее увиденными визуализациями и описывает их подобно людям. В основу ИНС заложен принцип работы человеческого мозга. Используя алгоритмы, которые имитируют процессы реальных нейронов, разработчики могут заставить сеть «учиться» подобно ребенку, познавая различные процессы, явления и изучая предметы и объекты окружающего мира. Исследователи называют этот процесс «построением связи между языком и визуальными данными».

Как говорится в публикации источника, система по-прежнему далека от совершенства и может иногда ошибаться, распознавая «маленькую девочку с феном возле головы» на фотографии, где изображена взрослая женщина, которая осторожно держит большой пончик, или принимая пару с праздничным тортом за «мужчину в зеленой футболке, стоящего рядом со слоном». Еще один приме – снимок с любознательным жирафом описан как «выглядывающая из окна собака». Впрочем, в большинстве случаев эти описания являются вторичными догадками – наряду с предположением о слоне система правильно определяет пару с тортом как «Находящаяся на улице женщина с кокосовым тортом, на который смотрит мужчина».

Самостоятельно оценить качество работы NeuralTalk можно с помощью специальной демо-версии, доступной на сайте Стэнфордского университета.

В отличие от всех предыдущих попыток создать алгоритм описания фотографий, включая эксперимент Google 2012 года, проект NeuralTalk учитывает не только объекты в кадре, но и их действия.

«Я рассматриваю визуальную информацию на изображениях и видеороликах как темную материю интернета. И вот сейчас мы проливаем на нее первые лучи света», – сказал Фей-Фей Ли в интервью The New York Times в прошлом году.

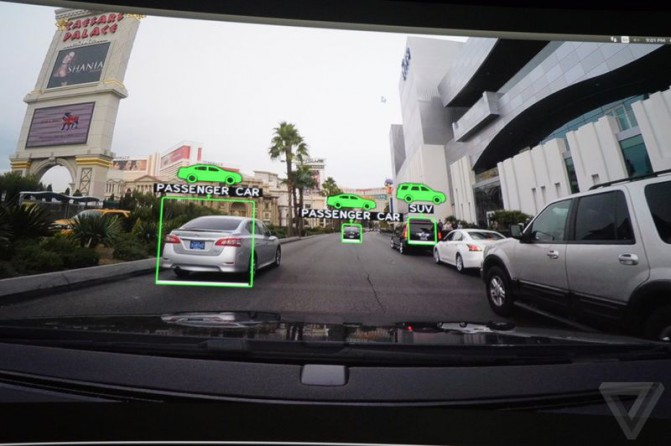

В будущем технологии вроде NeuralTalk могут найти применение в облачных сервисах вроде Google Photos, тем самым существенно улучшив возможности поиска – пользователи смогут в считанные секунды находить снимки вроде «селфи на Таймс-сквер» среди десятков тысяч семейных фотографий. Качество поисковой выдачи также существенно улучшиться: интернет-пользователи предположительно смогут искать на YouTube или Google точные сцены, вместо фотографий и видеозаписей осведомленных создателей, промаркированных соответствующим образом. Спектр потенциального применения ИНС достаточно широк и не ограничивается только цифровыми сервисами. К примеру, на недавней выставке CES глава NVIDIA Дженсен Хуанг анонсировал Drive PX – автомобильный «суперкомпьютер», который включает в себя технологию «компьютерного зрения на базе глубинных нейронных сетей».

Источник: The Verge

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: