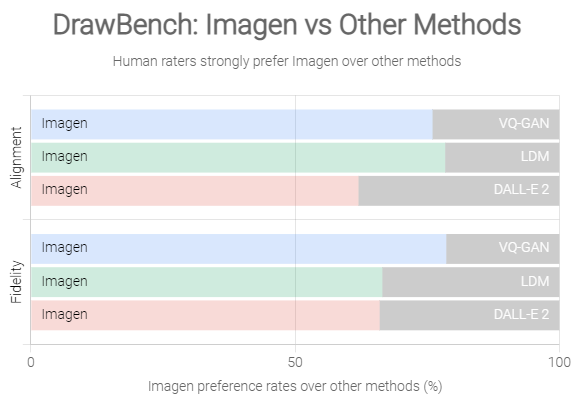

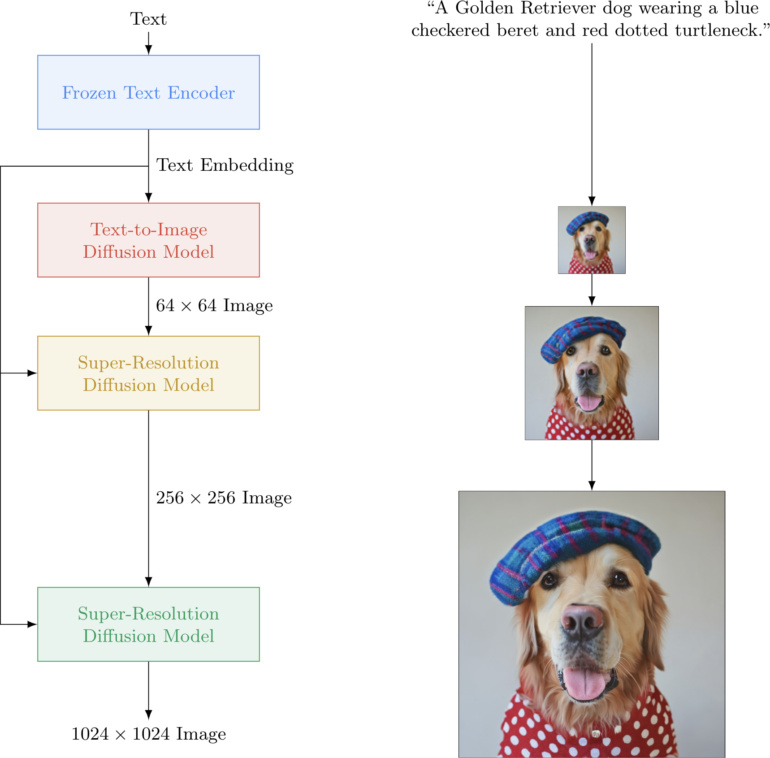

Команда Google Brain представила нейромережу-художника, яка розпізнає текст із використанням великих мовних моделей, після чого видає фотореалістичний малюнок. При цьому Imagen генерує першу картинку розміром 64х64 пікселів, а потім підвищує роздільну здатність до 256х256 і 1024х1024 пікселів, в процесі додаючи деталі. ШІ Imagen вже перевершив DALL-E 2 за якістю картинок.

«Наше ключове відкриття полягає в тому, що універсальні великі мовні моделі (наприклад, T5), попередньо навчені на текстових масивах, напрочуд ефективні при кодуванні тексту для синтезу зображень: збільшення розміру мовної моделі в Imagen значно підвищує як точність вибірки, так і вирівнювання зображення і тексту», — заявили розробники.

Команда Google також повідомила про етичні проблеми, хоча і не вдалася в подробиці про тривожний контент, що генерується Imagen. Однак у Google Brain зазначили, що нейромережа «кодує кілька соціальних упереджень та стереотипів, у тому числі загальну упередженість щодо створення зображень людей зі світлішими відтінками шкіри та схильність до зображень, що зображають різні професії, що відповідають західним гендерним стереотипам».

Все тому, що Imagen «згодували» набори даних з інтернету без 100% попереднього відбору. А інформація такого роду часто показує «соціальні стереотипи, репресивні точки зору та принизливі чи інакше шкідливі асоціації з маргіналізованими групами ідентичності». Багато навчальних даних відфільтрували від небажаного контенту. Але використовували й набір даних LAION-400M, що містить широкий спектр неприйнятного контенту, порнографічні зображення, образи расистів і шкідливі соціальні стереотипи.

Тому вихідний код не представлено публіці.

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: