С появлением генеративных ИИ, способных создавать высококачественные изображения, остро обозначилась проблема быстрого распознавания фейков. Недавнюю подделку взрыва в Пентагоне довольно легко распознать по деталям, однако многие даже не пытаются это делать – фейк распространился очень быстро.

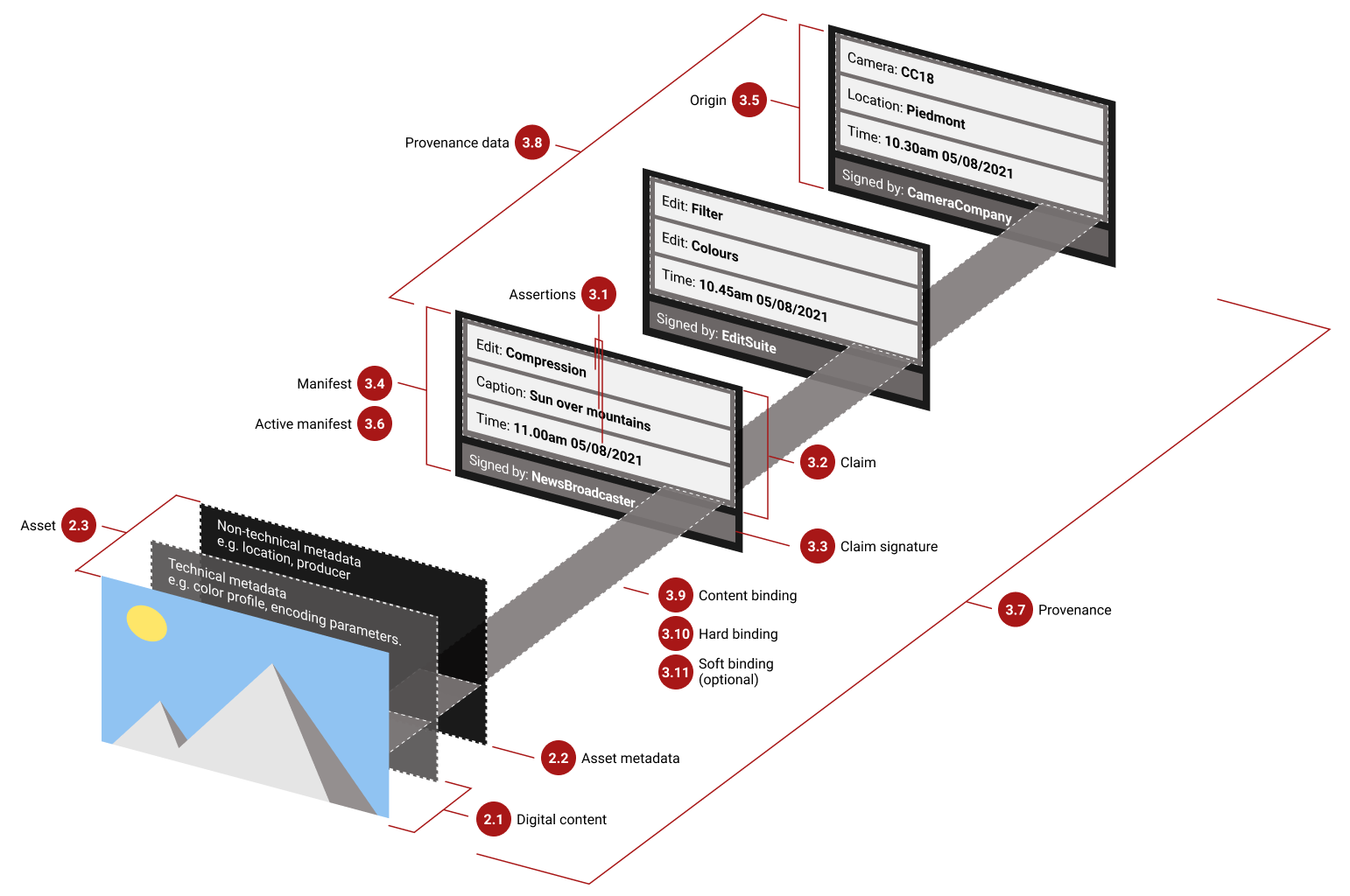

Microsoft внедряет спецификацию Coalition for Content Provenance and Authenticity (C2PA) на основе криптографических методов, которая позволит сайтам идентифицировать изображения, созданные ИИ, и помечать тем или иным образом. Стандарт разработан совместно с Adobe, ARM и Intel. Microsoft внедряет его прежде всего в своих продуктах, таких как Bing Image Creator на основе DALL-E 2.

Чтобы распознавались изображения, разработанные программами других компаний, необходима поддержка с их стороны. Adobe поддерживает C2PA в своих инструментах генеративного ИИ, но другой важный игрок, Stability AI, заявил о готовности принять собственную похожую спецификацию. Google намерен использовать встроенные метаданные для обозначения визуальных медиа, созданных ИИ. Shutterstock и Midjourney тоже разработали собственные рекомендации по обозначению ИИ-контента. Усилия этих и других компаний предстоит объединить.

Помимо распознавания созданных ИИ изображений, Microsoft разрабатывает средства автоматической модерации неприемлемого текстового и визуального контента с помощью искусственного интеллекта. Инструмент Azure AI Content Safety работает с картинками и текстом на многих языках, сигнализируя модераторам о неприемлемом содержимом и присваивая ему индекс серьезности.

«Новые модели ИИ способны намного лучше понимать контент и культурный контекст. Они с самого начала многоязычны и дают четкие объяснения, позволяя пользователям понять, почему контент был помечен или удален».

В основе Azure AI Content Safety лежит система безопасности, с которой уже работают чат-бот Microsoft в Bing и Copilot. Система защищает от предвзятого, сексистского, расистского, ненавистнического, жестокого контента и интегрирована в Azure OpenAI Service.

Источники: TechCrunch и TechCrunch

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: