Оновлення у Stable Diffusion — ШІ-генераторі текстів у зображення — ускладнило імітацію певних стилів художників або створення оголених зображень, але пропонує інші функціональні покращення.

Stability AI, компанія, що фінансує та розповсюджує програмне забезпечення ШІ-генератора, щойно анонсувала Stable Diffusion 2. У новій версії оновлені ключові компоненти моделі та покращені певні функції, як-от масштабування (можливість збільшення роздільної здатності зображень) і малювання (редагування з урахуванням контексту). Але зміни також ускладнюють для Stable Diffusion створення певних типів зображень (зокрема еротичних та порнографічних матеріалів, фотореалістичних зображень знаменитостей та зображень, що імітують твори певних митців).

Це викликало шквал критики у соцмережах: “Вони зіпсували модель”, прокоментував користувач на сабреддіті Stable Diffusion. “Неприємний сюрприз», — написав інший на офіційному сервері Discord.

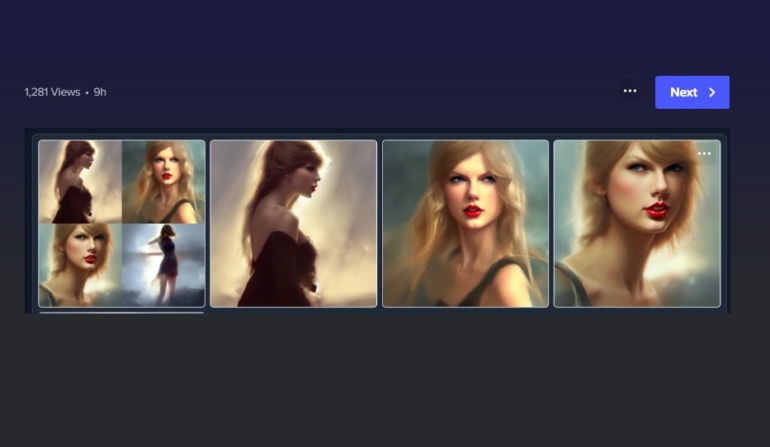

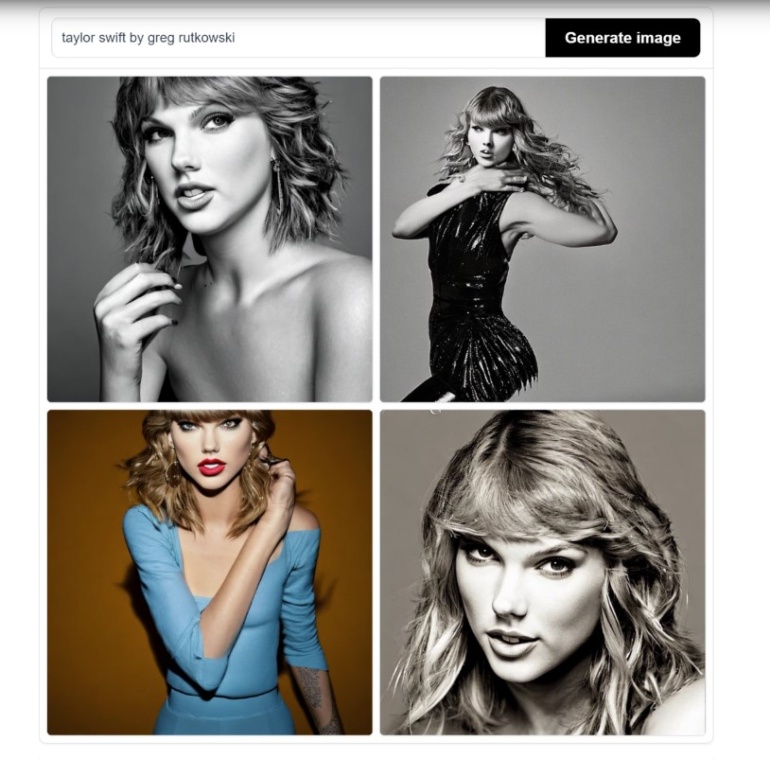

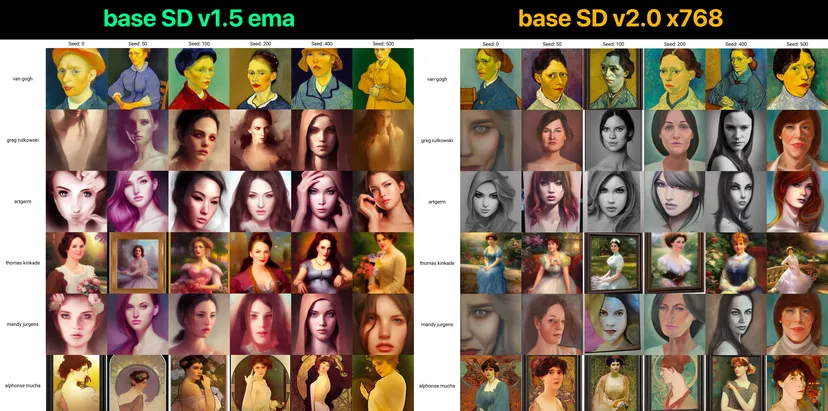

Користувачі відзначають, що запит у Stable Diffusion 2 згенерувати зображення в стилі цифрового художника Грега Рутковські — більше не видає витвір мистецтва, який дуже нагадує власний стиль митця. Порівняйте, наприклад, ці зображення:

“Що ви зробили з Грегом?”, — прокоментував один з користувачів Discord.

Зміни в Stable Diffusion помітні, оскільки програмне забезпечення має величезний вплив і допомагає встановлювати норми на швидкозмінній сцені ШІ-генераторів. На відміну від моделей-конкурентів, таких як DALL-E від OpenAI, Stable Diffusion має відкритий код, що дозволяє спільноті швидко покращувати інструмент, а розробникам – безплатно інтегрувати його у свої продукти.

Але це також означає, що Stable Diffusion має менше обмежень у використанні, що також викликало критику. Зокрема, багато митців, як-от Рутковські, роздратовані тим, що Stable Diffusion та інші генератори зображень навчалися на їхніх роботах без їхньої згоди та тепер можуть відтворювати їхні стилі.

Питання полягає у тому, чи є таке копіювання з підтримкою штучного інтелекту законним? Експерти кажуть, що навчання моделей штучного інтелекту на захищених авторським правом даних, ймовірно, є законним, але деякі випадки використання можуть бути оскаржені в суді.

Користувачі Stable Diffusion припустили, що зміни в модель були внесені Stability AI, щоб пом’якшити такі потенційні юридичні проблеми. Однак, коли журналісти The Verge запитали засновника Stability AI Емада Мостака, чи це так, він не відповів. Хоча й підтвердив, що Stability AI не видалив зображення художників із тренувальних даних (як припускали багато користувачів). Натомість зменшена сама здатність моделі копіювати художників.

“Не було спеціального фільтрування митців”, — сказав Мостак.

Little comparison thread between v1 & v2, using prompts and examples from @_StockAI

👈 V1 V2 👉 https://t.co/Npc9NgeuUO pic.twitter.com/LMGeHRwa4l

— Danny Postma (@dannypostmaa) November 24, 2022

Що було дійсно видалено з тренувальних даних Stable Diffusion — так це оголені та порнографічні зображення. ШІ-генератори зображень вже використовуються для створення порнографічних зображень — фотореалістичних та в стилі аніме. Однак ці моделі також можна використовувати для створення зображень, що нагадують конкретних осіб (відомі як примусова порнографія), і зображень жорстокого поводження з дітьми.

Обговорюючи зміни Stable Diffusion 2 в офіційному Discord програмного забезпечення, Мостак зазначає, що останній варіант використання і є причиною фільтрації.

Один користувач сабреддіту Stable Diffusion сказав, що видалення вмісту NSFW Скорочення NSFW використовується на позначення адрес ресурсів чи гіперпосилань, що містять оголеність, порнографію чи ненормативну лексику. було “цензурою” та “суперечило духовній філософії відкритого коду”:

Скорочення NSFW використовується на позначення адрес ресурсів чи гіперпосилань, що містять оголеність, порнографію чи ненормативну лексику. було “цензурою” та “суперечило духовній філософії відкритого коду”:

“Вирішувати, створювати контент NSFW чи ні, має кінцевий користувач”.

Інші, однак, зауважили, що відкритий код Stable Diffusion дозволяє легко додати тренувальні дані з оголеним тілом до випусків сторонніх розробників і що нове програмне забезпечення не впливає на попередні версії:

“Не лякайтеся через відсутність у V 2.0 митців/NSFW, незабаром ви зможете створити свою улюблену знаменитість оголеною”.

First tests with the new @StableDiffusion V2 depth2image feature. This has potential…@EMostaque @StabilityAI #stablediffusionv2 pic.twitter.com/XZGng0w5HJ

— Saad Ahmed (@microsaad) November 24, 2022

Хоча зміни у Stable Diffusion 2 роздратували деяких користувачів, багато інших високо оцінили його потенціал для глибшої функціональності, зокрема нову здатність програмного забезпечення створювати вміст, який відповідає глибині наявного зображення. Інші сказали, що зміни дійсно ускладнили швидке створення високоякісних зображень, але швидше за все цю функцію покращать в наступних версіях.

Сам Мостак порівняв нову модель з “основою для піци, яка дозволяє будь-кому додавати інгредієнти (тобто тренувальні дані) на свій вибір”.

“Хороша модель повинна бути доступною для всіх, і якщо ви хочете додати щось — додайте”, — написав він на Discord.

Мостак також сказав, що майбутні версії Stable Diffusion використовуватимуть навчальні набори даних, які дозволятимуть митцям підтверджувати або скасовувати свою участь.

Загальнодоступну демонстрацію Stable Diffusion Version 2 можна переглянути тут.

Джерело: The Verge

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: