Исследователи из Массачусетского технологического института разработали алгоритм, который способен реконструировать облик человека на основе записи его голоса. Как сообщает Futurism, для работы ИИ достаточно короткого аудиоклипа.

В основу алгоритма, получившего название Speech2Face, положена генеративно-состязательная нейросеть, обученная на датасете AVSpeech, способная сопоставлять особенности речи с рядом биометрических характеристик человека. Проанализировав запись продолжительностью до 6 секунд, программа выдает примерное изображение лица говорящего.

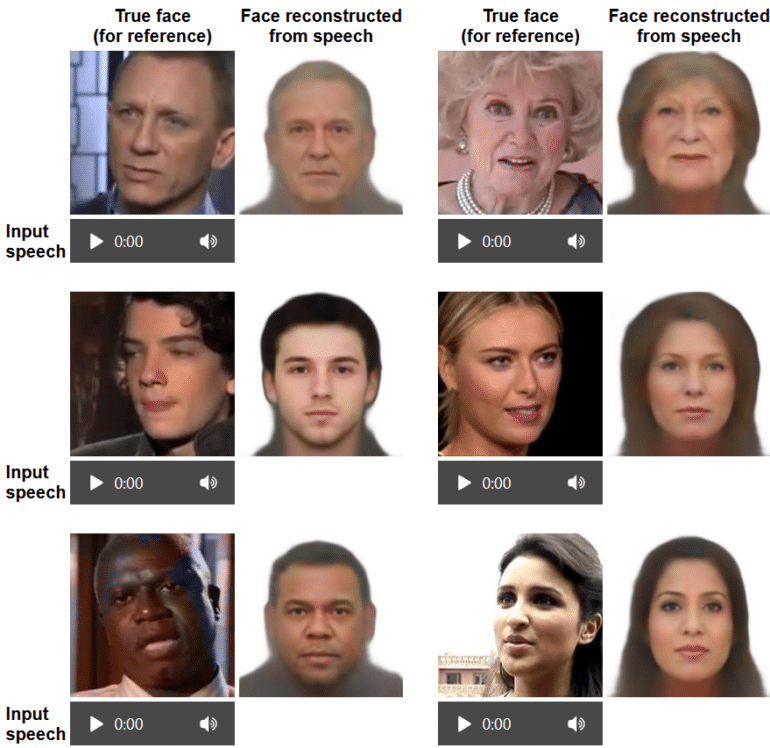

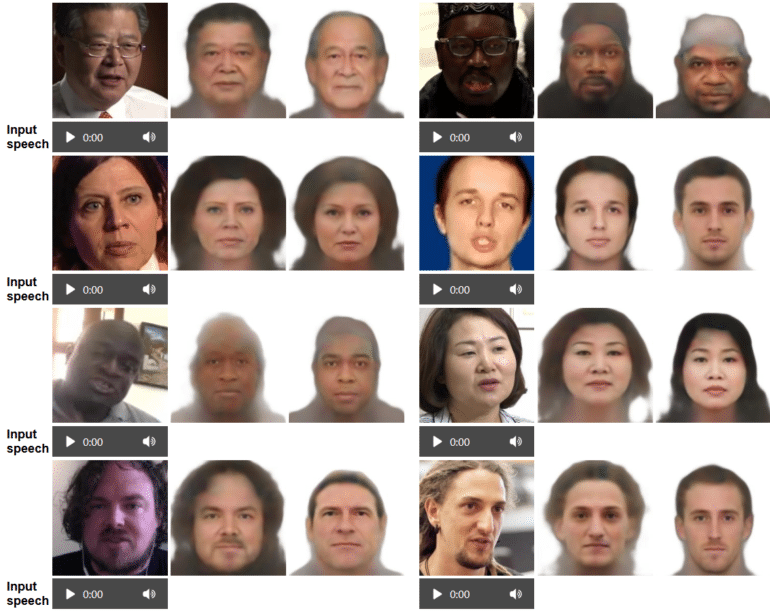

Результаты работы ИИ далеки от портретного сходства, но в качестве доказательства жизнеспособности концепции впечатляют: алгоритм достаточно уверенно определяет пол говорящего, его возраст (c точностью в 10 лет) и расовую принадлежность.

«Таким образом, Speech2Face в очередной раз подтверждает, что современные алгоритмы способны делать невероятные выводы на основе крошечных фрагментов данных», — указывает Futurism.

Отметим, что целью работы исследователей не было точное восстановление внешности человека по его голосу; ученые сосредоточились на воссоздании конкретно пола, возраста и этнической принадлежности. Именно поэтому точно показать по голосу, как выглядит человек, пока что нельзя, однако в дальнейшем авторы планируют совершенствовать разработку.

Что касается перспектив коммерциализации решения, то по словам исследователей, технология в первую очередь пригодится сервисам визуализации аудиозвонков и разработчикам видеоигр, которые смогут воссоздавать виртуальные аватары пользователей с более высокой точностью, а также правоохранительным органам, которые получат возможность эффективнее идентифицировать телефонных хулиганов. В то же время, авторы предупреждают, что точность воссоздания внешности по голосу всегда будет относительно низкой из-за огромного множества факторов, влияющих на речь человека и качество ее записи.

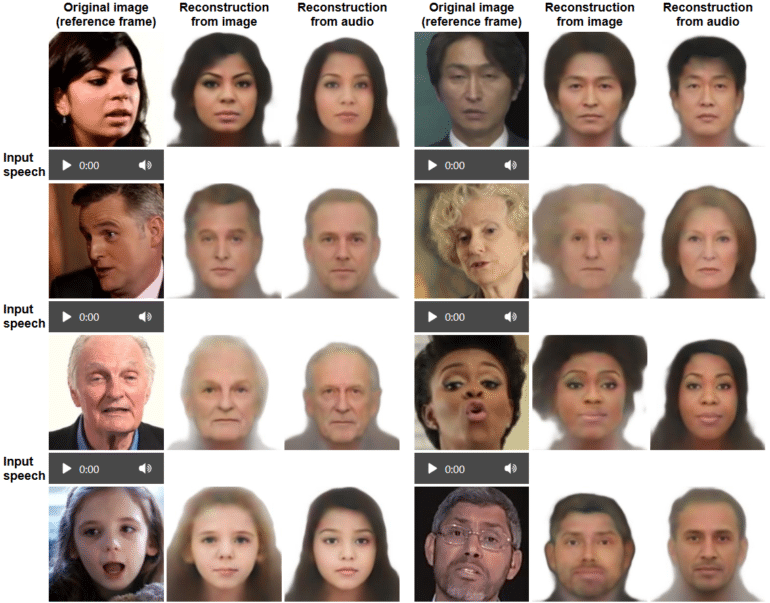

В первом столбике находятся кадры с видео, на которых запечатлено реальное лицо человека. Во втором столбике изображены лица, сгенерированные нейросетью VGG-Face, которая использует особенности лицá человека из видео для создания изображения лица в анфас с нейтральным выражением. В третьем столбике — ли́ца, сгенерированные Speech2Face на основе аудиодорожки с видео.

Кроме того, ученые отмечают, что их работа носит также исследовательскую пользу: генерация лиц на основе голоса поможет лучше изучить корреляцию голоса с внешностью.

Напоследок отметим, что создатели Speech2Face уже призвали к осторожности всех, кто планирует развивать и применять эту технологию, дабы исключить возможные нарушения конфиденциальности.

Источник: hightech.plus

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: