Вряд ли эта новость вам понравится, но Google может прочитать кое-что из того, что вы когда-то написали ИИ.

В статье-расследовании Fast Company утверждается, что поисковик индексирует диалоги с ChatGPT, которыми вы делились с друзьями, семьей или коллегами — фактически превращая частную переписку в результаты поиска, отображаемые миллионам людей.

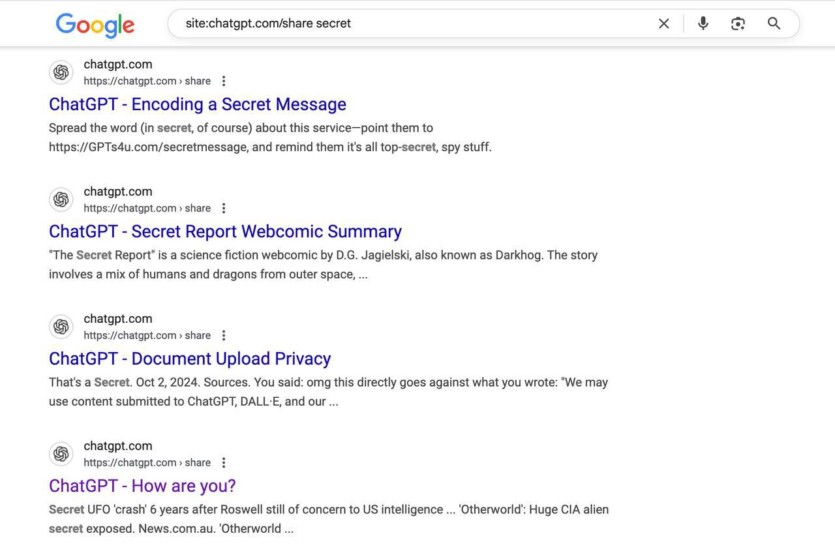

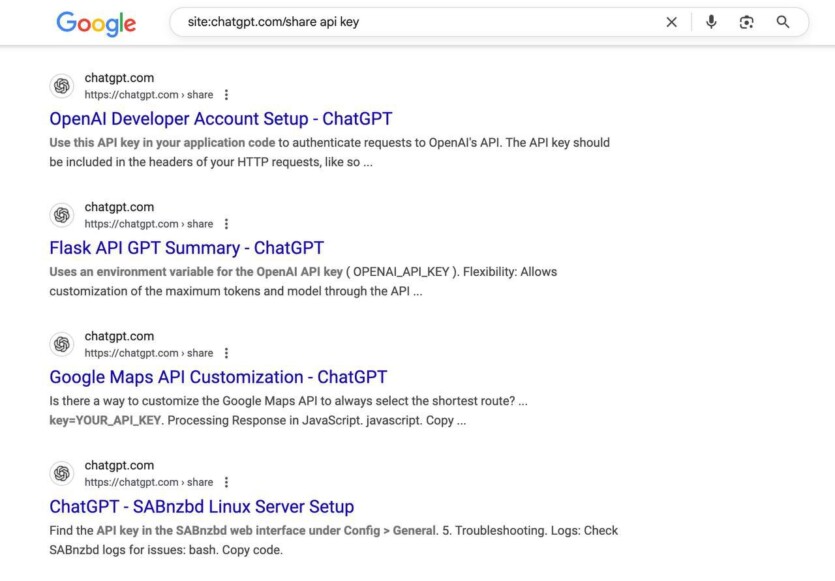

Простой поиск в Google по части ссылки, появляющейся после нажатия кнопки «Поделиться» в ChatGPT, выдает разговоры иногда с глубоко личной информацией — например борьбу с зависимостями, опыт физического насилия или серьезные психические расстройства. Да, чат-бот в этом случае не раскрывает имен или ников пользователей, но некоторые могут идентифицировать сами себя уже в запросах, делясь слишком специфическими личными деталями.

Журналисты нашли около 4 500 подобных диалогов в поиске Google. Большинство не содержат личных или идентификационных данных, но исключения есть (включая имена, место жительства и частные обстоятельства) — очевидно, что Fast Company решил не ссылаться на такие разговоры и не описывать их в деталях.

В одном из разговоров, которые проиндексировал Google, пользователь подробно описывал свою сексуальную жизнь и неудовлетворенность пребыванием за границей, утверждая, что страдает от ПТСР и ищет поддержки; в чате упоминаются подробности из семейной истории и отношений с родственниками и друзьями. В другом тем временем — обсуждается проявление психопатического поведения у детей и возраст, когда такое поведение становится заметным; еще в одном разговоре человек называет себя жертвой «ментального программирования» и ищет пути «декодирования» себя, чтобы смягчить полученную психологическую травму.

«Я просто шокирована», — говорит Карисса Велис, этик из Оксфордского университета, которая специализируется на теме конфиденциальности в ИИ. «Как исследовательница конфиденциальности я прекрасно знаю, что такие данные не являются частными. Но «неприватные» — это очень широкое понятие. И тот факт, что Google индексирует такие чувствительные разговоры — просто ужасает».

Мы не имеем данных по Украине по использованию ChatGPT для психологической поддержки (на май 2025 года только 26% украинцев имели опыт практического использования искусственного интеллекта), однако последние опросы показали, что почти половина американцев за последний год обращались к чат-ботам как к терапевтам. Три четверти из них искали помощь при тревожности, двое из трех — в отношении личных вопросов, а почти 60% — в связи с депрессией.

То, что ваш казалось бы частный сеанс с ИИ может легко попасть в результаты поиска в Google — не единственная проблема. В одном из последних исследований боты фактически провалили тест на психотерапевтов, где отказывались работать с алкоголиками или даже выдавали перечень «самых высоких мостов» людям в депрессии. Конечно, указанные ситуации были смоделированы, однако в СМИ все чаще появляются истории о реальном опыте людей с психическими расстройствами в сотрудничестве с ИИ, где один из инцидентов завершился смертельной стрельбой в полиции, другой — самоубийством подростка.

Google и OpenAI отказались комментировать это расследование для Fast Company.

Ранее гендиректор компании-разработчика ChatGPT Сэм Альтман предупреждал, чтобы пользователи не делились с чат-ботом личными данными, поскольку компанию могут заставить предоставить эти данные по решению суда. Между тем одно из предыдущих решений уже обязало компанию навсегда сохранять все разговоры людей с ChatGPT.

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: