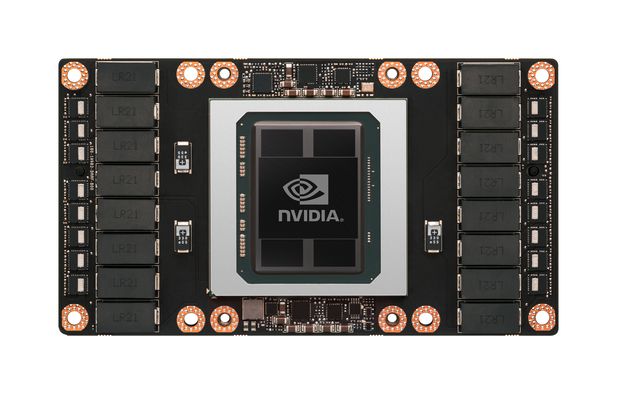

Во время вчерашнего мероприятия компания Nvidia анонсировала также графический ускоритель Tesla P100, сердцем которого служит GPU GP100 архитектуры Pascal. Как утверждается, ускоритель Tesla P100 способен в 12 раз (!) быстрее выполнять различные задачи, связанные с глубоким обучением нейронных сетей, по сравнению с флагманской моделью прошлого поколения.

Проект ускорителя Tesla P100 имеет огромное значение для Nvidia, прямо пропорциональное ответственности, лежащей на плечах калифорнийского гиганта. По данным компании, расходы на научно-исследовательские работы и разработку составили более $2 млрд, а количество транзисторов, которые насчитывает GPU GP100, составляет колоссальную цифру – 15,3 млрд штук. Это абсолютный мировой рекорд. Для сравнения, GPU Fiji содержит «каких-то» 8,9 млрд транзисторов, а у GM200 таковых 8 млрд. Кроме глубокого обучения нейронных сетей, ускоритель Tesla P100 также планируют использовать для решения всевозможных трудоёмких вычислительных задач.

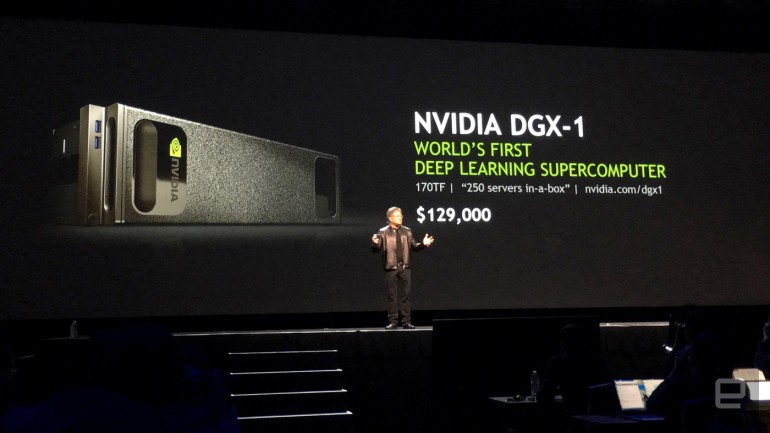

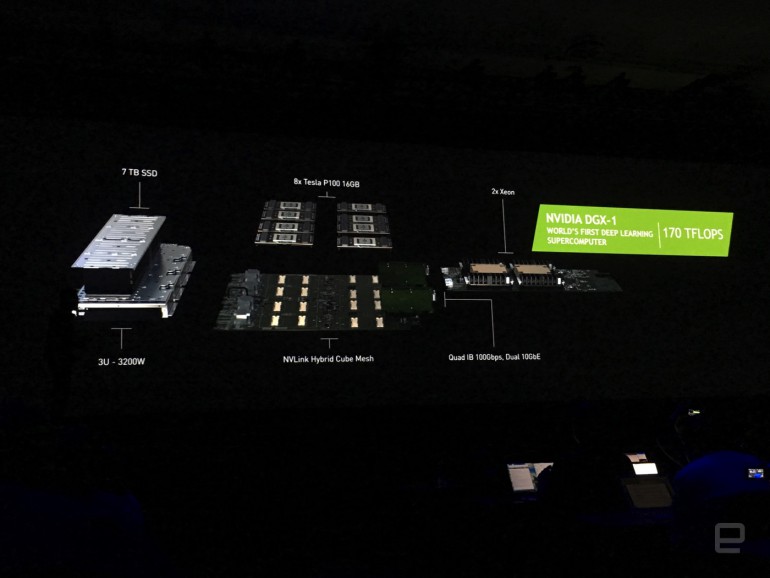

Кроме самого Tesla P100, компания показала также суперкомпьютер Nvidia DGX-1 для глубокого обучения с впечатляющей производительностью 170 TFLOPS на основе восьми таких ускорителей. Разумеется, цена этого суперкомпьютера впечатляет не меньше – $129 тыс. Он выполнен в корпусе формата 3U и потребляет 3200 Вт.

По словам Nvidia, это самый производительный и самый энергоэффективный суперкомпьютер для глубокого обучения. Кроме того, системы Nvidia DGX-1 будут поставляться на рынок со всем необходимым ПО для работы в этом направлении. В частности, упоминается платформа Nvidia Deep Learning GPU Training System (DIGITS) и библиотека Nvidia CUDA Deep Neural Network library (cuDNN) пятой версии. В числе первых системы Nvidia DGX-1 получат исследователи, занимающееся разработкой технологий в области ИИ, из MIT, Стэнфорда, Беркли и других ведущих университетов. Поставки начнутся уже в июне этого года.

Не лишним будет отметить, что оснащение суперкомпьютера также включает кэширующие SSD суммарным объёмом 7 ТБ, два порта 10GbE и четыре InfiniBand 100Gb.

Первоначально компания Nvidia сделала себе имя на выпуске мощных графических чипов для игровой индустрии. Обработка графической информации требует огромной вычислительной мощности. Так, можно ли считать глубокое обучение нейронных сетей своеобразной формой искусственного интеллекта, где информация последовательно проходит сквозь плотные слои из искусственных нейронов в целях обучения компьютера распознаванию сложных образов. В условиях стремительного роста числа технологических компаний, заинтересованных в разработке технологий глубокого обучения, — Google, Microsoft, Amazon, Facebook, Baidu и т.д. — Nvidia позиционирует себя в качестве производителя чипов для систем искусственного интеллекта.

Когда речь заходит о расширении границ глубокого обучения, вычислительная мощность имеет ключевое значение. Согласно данным статьи в журнале Nature, ИИ-подразделение Google – DeepMind – использовало огромный объем вычислительных ресурсов для обучения игре в го уже известной всему миру программы AlphaGo. Если быть точным, 1202 CPU и 176 GPU.

Источник: The Verge

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: