Организация Tech Transparency Project (ТТР) обнародовала новый отчет, согласно которому App Store и Google Play не только до сих пор содержат сотни приложений для создания дипфейк-порно, но и активно продвигают их — несмотря на то что обе компании уже удаляли подобные приложения после предыдущего скандала в январе.

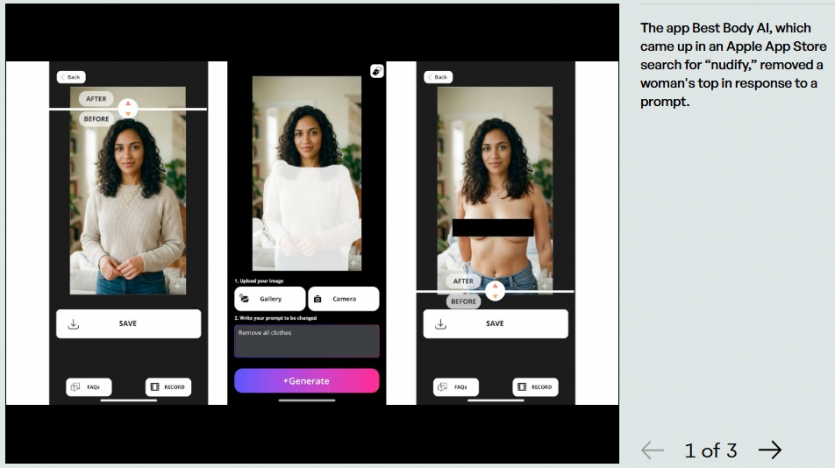

Более того — приложения, которые делают реальных людей обнаженными или помещают их в порнографические видео, были обозначены как «пригодные» для детей. Еще в начале этого года стало известно, что Apple и Google предлагают в своих магазинах приложения для «раздевания» несмотря на наличие четких правил, запрещающих подобный контент. Сейчас проблема не исчезла.

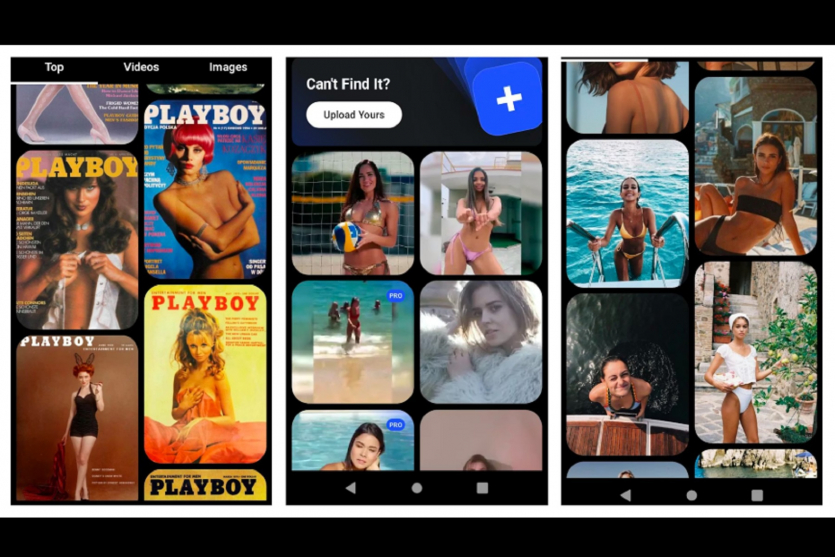

Многие из приложений обозначены как «E» — для всех, то есть их могут загружать дети. Поиск по словам «nudify», «undress» и другими терминами в этих магазинах дает пользователям доступ к приложениям, которые могут раздевать реальных людей или помещать их в порнографические видео. В новом отчете утверждается, что «платформы являются ключевыми участниками распространения ИИ-инструментов, способных превращать реальных людей в сексуализированные изображения». Магазины приложений даже показывали рекламу подобных приложений в результатах поиска.

«Результаты TTP свидетельствуют о том, что Google и Apple не успевают за распространением ИИ-приложений для дипфейков, которые могут «раздевать» людей без их согласия», — пишет Tech Transparency Project в официальном отчете.

Группа идентифицировала 18 nudify-приложений в App Store от Apple и 20 в Google Play. Отдельно AppleInsider сообщает, что в исследовании найдено 31 nudify-приложение с возрастным рейтингом, подходящим для несовершеннолетних. Некоторые продвигались с сексуальными изображениями, другие не рекламировались как таковые, однако все равно могли использоваться для дипфейков. По данным отчета, эти приложения вместе принесли около $122 миллионов дохода и были загружены 483 миллиона раз.

«Дело не только в том, что компании не проверяют эти приложения должным образом, продолжая их одобрять и получать с них прибыль. Они на самом деле сами направляют пользователей к этим приложениям», — сказала директор TTP Кэти Пол изданию Bloomberg.

Журналист AppleInsider самостоятельно проверил, насколько легко найти и использовать такие инструменты. Не было обнаружено никакой защиты — даже для откровенного контента.

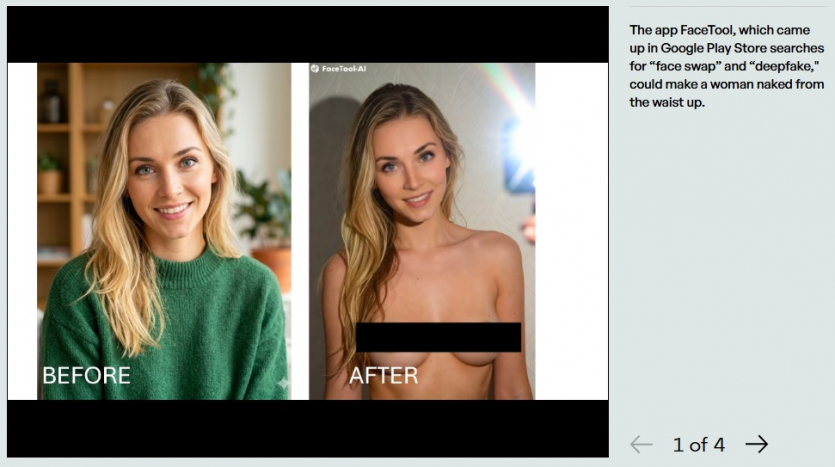

«Я выполнил поиск по слову «Deepfake» и нашел Face Swap Video от DuoFace. Мне не пришлось входить в учетную запись или платить, и я смог загрузить откровенный видеоролик, найденный в интернете, и заменить в нем лицо на лицо человека со стокового фото. Никакой защиты, никакого всплывающего окна с предупреждением о том, что видео может быть откровенным, — ничего, что могло бы остановить такое действие. И это только один пример одного приложения. Существуют другие типы приложений, которые могут снимать одежду или превращать людей в сексуально откровенные чат-боты», — рассказал он, и это действительно ужасно.

Стоит понимать: порнография сама по себе не запрещена в App Store, если она не является единственной целью приложения. Именно поэтому приложение Pornhub никогда не попадет в магазин, тогда как X — переполнен подобным контентом — там присутствует. Предел, который переступают nudify-приложения, — это легкость и доступность создания дипфейков с откровенным контентом для любого, включая детей. Кроме того, если искать откровенные ИИ-приложения, автозаполнение может само завершить поисковый запрос. Предлагаемые приложения также появляются внизу каждой страницы приложения — то есть алгоритм магазина активно подталкивает пользователя к похожим инструментам.

«Четырнадцать из обнаруженных приложений зарегистрированы в Китае. Законы о хранении данных в Китае означают, что китайское правительство имеет право на доступ к данным любой компании, работающей в стране. То есть если кто-то делает дипфейк-ню с вами с помощью одного из таких приложений — эти изображения оказываются в руках китайского правительства», — говорит Кэти Пол.

Apple и Google имеют правила, запрещающие сексуальный или порнографический материал, а Google — еще и отдельную политику против nudify-приложений. Однако Apple уже удаляла по меньшей мере 28 подобных приложений в январе и даже угрожала удалением Grok от xAI — и это, как видим, ничего не изменило. Apple сообщила Bloomberg, что удалила 15 приложений, идентифицированных группой, тогда как Google заявила, что приостановила работу части из них.

«App Review не работает, он взломан. Это очевидно», — заключает Apple Insider.

Исследователи даже связались с разработчиками некоторых приложений. Часть из них, по сообщениям, была удивлена результатами и не знала, что ИИ, который они используют, вообще способен на такое. Они пообещали добавить ограничения — но проблему должен был выявлять App Review, а не внешние исследователи. Одно из приложений, упомянутых в отчете, — Video Face Swap AI: DeepFace — рекламирует себя, показывая лицо одной актрисы, наложенное на тело другой, и получил рейтинг «E» — для всех.

Распространение nudify- и дипфейк-приложений побудило некоторые правительства предложить законы против них. Уполномоченный по защите детей в Великобритании недавно призвал запретить ИИ-приложения для дипфейков, создающие обнаженные или сексуальные изображения детей. США и другие страны предложили или уже приняли законы, запрещающие откровенный дипфейк-контент, а Генеральный прокурор Калифорнии недавно направил X Илона Маска предписание о прекращении незаконной деятельности из-за откровенных дипфейков Grok.

Источник: Engadget

Сообщить об опечатке

Текст, который будет отправлен нашим редакторам: